韻律邊界標注方法、裝置、設備、介質及程序產品與流程

1.本技術實施例涉及機器學習領域,特別涉及一種韻律邊界標注方法、裝置、設備、介質及程序產品。

背景技術:

2.語音合成(text-to-speech,tts)系統是一種可以將任意輸入文本轉換成相應語音的計算機系統,在語音合成系統中,需要對輸入文本的韻律邊界進行預測。精確的韻律邊界可以使得輸入文本合成的語音更貼近人聲,表達更為自然和準確。因此,精確標注了韻律邊界的訓練數據對于構建一個高質量的語音合成系統至關重要。

3.相關技術中,韻律邊界標注方法通常是從文本內容中提取相關特征信息,然后對這些相關特征信息進行特征分析,從而對文本內容的韻律邊界進行預測。

4.然而,上述相關技術中的韻律邊界標注方法的準確度較低。

技術實現要素:

5.本技術實施例提供了一種韻律邊界標注方法、裝置、設備、介質及程序產品,能夠提高韻律邊界標注的準確度。所述技術方案如下:

6.一方面,提供了一種韻律邊界標注方法,所述方法包括:

7.獲取目標文本和目標音頻,所述目標文本的文本內容與所述目標音頻的音頻內容匹配,所述目標文本為待進行韻律邊界識別的文本;

8.以字符為分析粒度提取所述目標文本的文本韻律特征表示;以及,以發聲內容為分析基礎提取所述目標音頻的音頻韻律特征表示;

9.將所述文本韻律特征表示和所述音頻韻律特征表示進行融合,得到融合韻律特征表示;

10.基于所述融合韻律特征表示對所述目標文本進行韻律邊界預測,得到與所述目標文本等長的韻律邊界標注結果,所述韻律邊界標注結果中包括以字符為粒度在所述目標文本上的進行劃分的韻律邊界。

11.另一方面,提供了一種韻律邊界標注裝置,所述裝置包括:

12.數據獲取模塊,用于獲取目標文本和目標音頻,所述目標文本的文本內容與所述目標音頻的音頻內容匹配,所述目標文本為待進行韻律邊界識別的文本;

13.特征提取模塊,用于以字符為分析粒度提取所述目標文本的文本韻律特征表示;以及,用于以發聲內容為分析基礎提取所述目標音頻的音頻韻律特征表示;

14.特征融合模塊,用于將所述文本韻律特征表示和所述音頻韻律特征表示進行融合,得到融合韻律特征表示;

15.特征分析模塊,用于基于所述融合韻律特征表示對所述目標文本進行韻律邊界預測,得到與所述目標文本等長的韻律邊界標注結果,所述韻律邊界標注結果中包括以字符為粒度在所述目標文本上的進行劃分的韻律邊界。

16.另一方面,提供了一種計算機設備,所述計算機設備包括處理器和存儲器,所述存儲器中存儲有至少一條指令、至少一段程序、代碼集或指令集,所述至少一條指令、所述至少一段程序、所述代碼集或指令集由所述處理器加載并執行以實現本技術實施例中任一所述的韻律邊界標注方法。

17.另一方面,提供了一種計算機可讀存儲介質,所述計算機可讀存儲介質中存儲有至少一條程序代碼,所述至少一條程序代碼由處理器加載并執行以實現本技術實施例中任一所述的韻律邊界標注方法。

18.另一方面,提供了一種計算機程序產品或計算機程序,該計算機程序產品或計算機程序包括計算機指令,該計算機指令存儲在計算機可讀存儲介質中。計算機設備的處理器從計算機可讀存儲介質讀取該計算機指令,處理器執行該計算機指令,使得該計算機設備執行本技術實施例中任一所述的韻律邊界標注方法。

19.本技術實施例提供的技術方案至少包括以下有益效果:

20.通過將目標文本的文本韻律特征表示和目標音頻的音頻韻律特征表示進行融合,得到融合韻律特征表示,對融合韻律特征表示進行韻律邊界預測,由于音頻韻律特征表示中包含有韻律邊界信息,從而提高了對目標文本進行韻律邊界標注的準確度;且以字符為粒度對目標文本進行分析和預測韻律邊界,提升了韻律邊界標注結果的細粒度,從而進一步提高了對目標文本進行韻律邊界標注的準確度。

附圖說明

21.為了更清楚地說明本技術實施例中的技術方案,下面將對實施例描述中所需要使用的附圖作簡單地介紹,顯而易見地,下面描述中的附圖僅僅是本技術的一些實施例,對于本領域普通技術人員來講,在不付出創造性勞動的前提下,還可以根據這些附圖獲得其他的附圖。

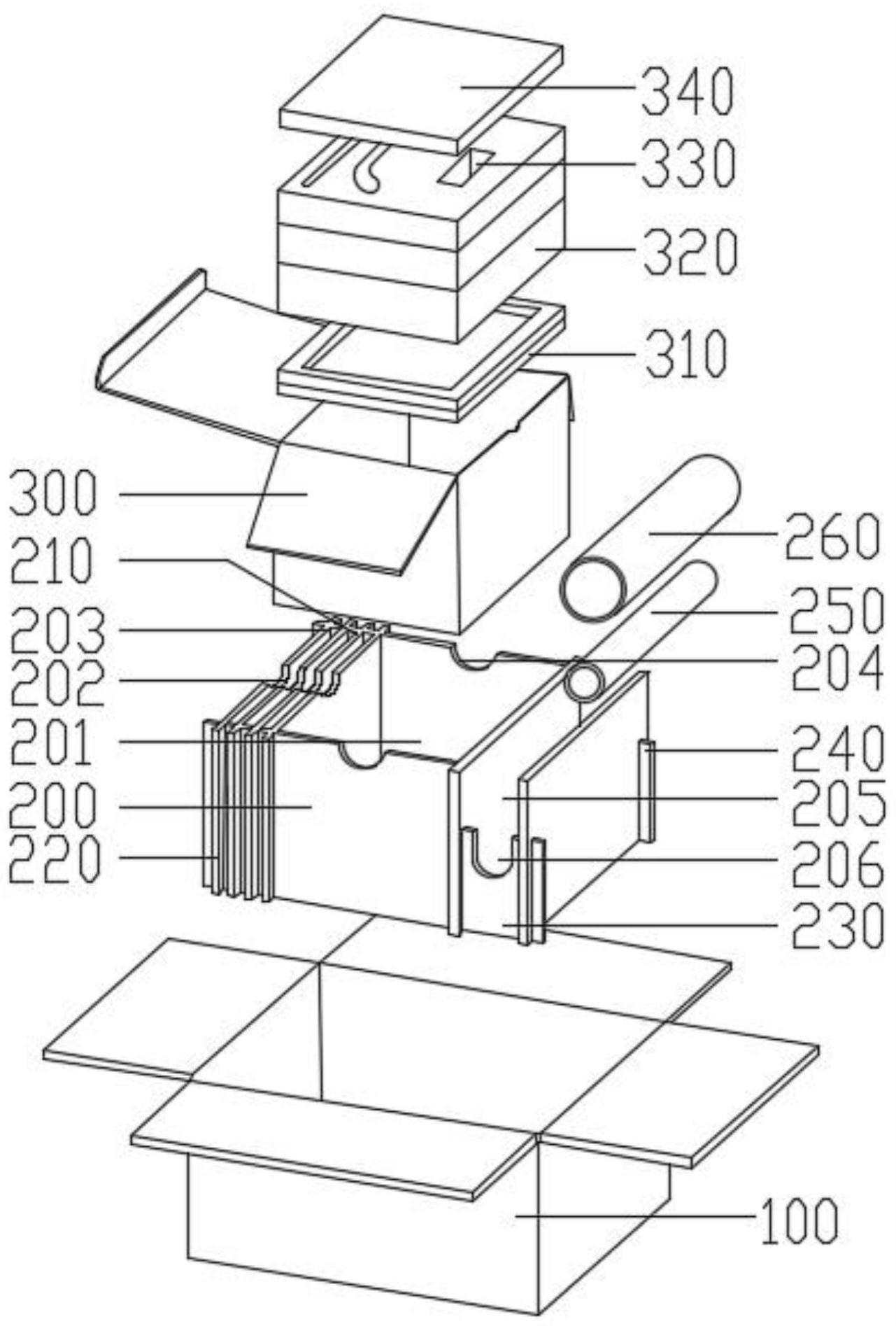

22.圖1是本技術一個示例性實施例提供的韻律邊界標注方法的示意圖;

23.圖2是本技術一個示例性實施例提供的實施環境的示意圖;

24.圖3是本技術一個示例性實施例提供的韻律邊界標注方法的流程圖;

25.圖4是本技術一個示例性實施例提供的韻律邊界文本標注示意圖;

26.圖5是本技術一個示例性實施例提供的韻律等級分層示意圖;

27.圖6是本技術另一個示例性實施例提供的韻律邊界標注方法的流程圖;

28.圖7是本技術一個示例性實施例提供的多模態融合模型的示意圖;

29.圖8是本技術另一個示例性實施例提供的韻律邊界標注方法的流程圖;

30.圖9是本技術一個示例性實施例提供的韻律邊界標注模型的示意圖;

31.圖10是本技術一個示例性實施例提供的自動指標評測數據;

32.圖11是本技術一個示例性實施例提供的一致性檢驗系數矩陣的示意圖;

33.圖12是本技術一個示例性實施例提供的訓練數據的獲取流程示意圖;

34.圖13是本技術一個示例性實施例提供的評測數據;

35.圖14是本技術一個示例性實施例提供的韻律邊界標注裝置的結構框圖;

36.圖15是本技術另一個示例性實施例提供的韻律邊界標注裝置的結構框圖;

37.圖16是本技術一個示例性實施例提供的服務器的結構框圖。

具體實施方式

38.為使本技術的目的、技術方案和優點更加清楚,下面將結合附圖對本技術實施方式作進一步地詳細描述,顯然,所描述的實施例是本技術一部分實施例,而不是全部的實施例。基于本技術中的實施例,本領域普通技術人員在沒有做出創造性勞動前提下所獲得的所有其他實施例,都屬于本技術保護的范圍。

39.本技術中術語“第一”“第二”等字樣用于對作用和功能基本相同的相同項或相似項進行區分,應理解,“第一”、“第二”之間不具有邏輯或時序上的依賴關系,也不對數量和執行順序進行限定。

40.首先,針對本技術實施例中涉及的名詞進行簡單介紹:

41.語音技術(speech technology):語音技術的關鍵技術有自動語音識別技術(automatic speech recognition,asr)和語音合成技術以及聲紋識別技術。讓計算機能聽、能看、能說、能感覺,是未來人機交互的發展方向,其中語音成為未來被看好的人機交互方式之一。

42.韻律邊界:韻律邊界用于對文本進行韻律等級的劃分,其位置會影響文本在表達時的自然程度和所表達的含義。不同的韻律等級代表不同的韻律,韻律是指音頻中聲音的節奏和規律。可選地,韻律用于指示在一段音頻中,每個字符對應的聲音的高低、強弱、發音的長短,以及字符與字符之間的停頓時間。其中,韻律等級包括:字(character,cc),語法詞(lexicon word,lw),韻律詞(prosodic word,pw),韻律短語(prosodic phrase,pph),語調短語(intonational phrase,iph)。

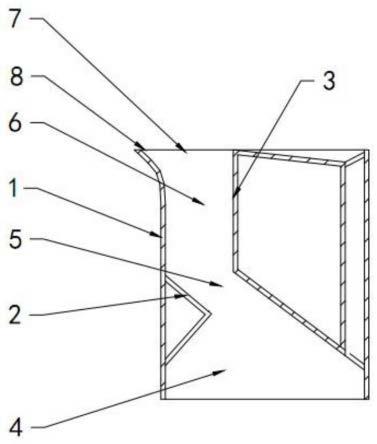

43.音素:音素是語音的最小單位,一個發音動作形成一個音素,例如:普通話“我”包含“w”和“o”兩個音素。其中,音素包括元音音素和輔音音素。

44.相關技術中,韻律邊界標注方法主要通過如下方式:

45.(1)通過人工標注韻律邊界。這種方式耗時較久且成本較高,并且不同標注員對于韻律詞和韻律短語的評判標準不一致,從而不同標注員標注的同一批數據不能直接一起使用。

46.(2)通過韻律邊界標注模型自動標注韻律邊界。相關技術中,韻律邊界標注模型通常是從文本內容中提取相關特征信息,然后對這些相關特征信息進行特征分析,從而對文本內容的韻律邊界進行預測,韻律邊界標注的準確度較低。

47.本技術實施例提供了一種韻律邊界標注方法,示意性的,請參考圖1,獲取目標文本101和與目標文本101匹配的目標音頻102,然后,對目標文本101和目標音頻102進行分析,從而對目標文本101進行細粒度韻律邊界標注預測,預測的具體過程如下:

48.示意性的,通過文本編碼器103提取目標文本101的文本韻律特征向量104,可選地,文本韻律特征向量104為包含目標文本101上下文特征的字向量;以及,通過音頻編碼器105提取目標音頻102的音頻韻律特征向量106,可選地,音頻韻律特征向量106為包含有目標音頻102韻律相關信息(例如:音高、音強等)的向量;將文本韻律特征向量104和音頻韻律特征向量106輸入到多模態融合解碼器107中,將文本韻律特征向量104和音頻韻律特征向量106進行融合得到融合韻律特征向量,對融合韻律特征向量進行分析預測,從而獲取與目標文本中的每個字符對應的韻律邊界標注序列,將目標文本與韻律邊界標注序列進行對齊,則可得到精確標注了韻律邊界的文本數據108。

49.本技術實施例提供的韻律邊界標注方法具有與人工標注相當的性能,能節省標注時間和成本,且使用統一標準來區分不同粒度的韻律邊界,從而獲得更高的標注一致性;本技術實施例提供的韻律邊界標注方法從文本和音頻中分別提取韻律邊界相關信息,通過多模態解碼器進行融合后解碼,從而獲取韻律邊界標注結果,由于韻律邊界信息本身包含在音頻模態中,音頻信息的引入能夠提高韻律邊界標注的準確度。

50.本技術實施例提供的韻律邊界標注方法至少可以應用于如下應用場景:

51.1、應用于語音合成系統。示意性的,語音合成系統實現為普通話語音合成系統,則獲取中文文本和與中文文本匹配的目標音頻,以中文文本中的每個漢字為分析粒度提取中文文本的文本韻律特征表示;以及,提取普通話音頻的音頻韻律特征表示;對文本韻律特征表示和音頻韻律特征表示進行融合,得到融合韻律特征表示;通過對融合特征表示的分析和預測,獲取與以中文文本中的每個漢字對應的韻律邊界標注序列,將中文文本和韻律邊界標注序列進行對齊和連接,則得到精確標注了韻律邊界的文本數據。將該文本數據輸入到語音合成系統中,輸出得到合成音頻,該合成音頻是基于文本數據中的韻律標注生成的音頻,提升了韻律自然度。可選地,上述合成音頻可以是任意音的與文本數據匹配的合成音頻。

52.2、應用于朗讀/歌唱練習中的自動反饋。示意性的,獲取朗讀/歌唱練習者的發音音頻,首先將該發音音頻通過語音識別系統轉化為無標注的練習文本,以無標注的練習文本中的每個字為分析粒度提取無標注的練習文本的文本韻律特征表示;以及,提取發音音頻的音頻韻律特征表示;對文本韻律特征表示和音頻韻律特征表示進行融合,得到融合韻律特征表示;通過對融合特征表示的分析和預測,獲取與無標注的練習文本中的每個字對應的韻律邊界標注序列,將無標注的練習文本和韻律邊界標注序列進行對齊和連接,則得到了經過韻律標注的練習文本,將該練習文本與練習庫中保存的標準文本進行對比得到對比結果,將對比結果發送給朗讀/歌唱練習者,則朗讀/歌唱練習者可以根據對比結果,改善發音,提高朗讀/歌唱水平。

53.值得注意的是,上述應用場景僅為示意性的舉例,本技術實施例對韻律邊界標注方法的其他應用場景不加以限定。

54.本技術實施例提供的韻律邊界標注方法可以由終端或者服務器單獨實現,也可以由終端和服務器共同實現。以終端和服務器共同實現該韻律邊界標注方法為例。圖2本技術一個示例性實施例提供的實施環境示意圖,如圖2所示,該實施環境中包括終端210、服務器220和通信網絡230,其中,終端210和服務器220之間通過通信網絡230連接。

55.在一些可選的實施例中,終端210中安裝和運行有具有韻律邊界標注功能的目標應用程序。該目標應用程序可以實現為語音合成應用程序、語音識別應用程序、口語練習應用程序、車載語音導航應用程序等,本技術實施例對此不加以限定。示意性的,當需要對目標文本進行韻律邊界標注時,對象將目標文本和與目標文本對應的目標音頻輸入到終端210中,終端210將對象輸入的目標文本和目標音頻發送至服務器220。

56.在一些可選的實施例中,服務器220用于為終端210中安裝的目標應用程序提供韻律邊界標注服務,服務器220中設置有文本編碼器、音頻編碼器和多模態融合解碼器。示意性的,服務器220接收到終端210發送的目標文本和目標音頻后,將目標文本輸入到文本編碼器中提取目標文本的文本韻律特征表示;以及,將目標音頻輸入到音頻編碼器中提取目

標音頻的音頻韻律特征表示;將文本韻律特征表示和音頻韻律特征表示輸入到多模態融合解碼器中,從而將文本韻律特征表示和音頻韻律特征表示進行融合,得到融合韻律特征表示,基于融合韻律特征表示對目標文本進行韻律邊界預測,得到與目標文本等長的韻律邊界標注結果;最終服務器220將該韻律邊界標注結果反饋給終端210,可選的,終端210對韻律邊界標注結果進行顯示。

57.在一些可選的實施例中,音頻編碼器、文本編碼器以及多模態融合解碼器中的至少一種也可以部署在終端210,由終端210實現部分或者全部韻律邊界標注過程,本技術實施例對此不加以限定。

58.在一些可選的實施例中,上述終端210中安裝的目標應用程序還提供有語音轉換功能,示意性的,對象將目標文本輸入到終端210中,終端210將對象輸入的目標文本轉換為與目標文本對應的目標音頻。

59.在一些可選的實施例中,上述終端210中安裝的目標應用程序還提供有語音識別功能,示意性的,對象將目標音頻輸入到終端210中,終端210將對象輸入的目標音頻轉化為與目標音頻對應的目標文本,該目標文本為無韻律邊界標注的文本。

60.其中,終端210包括智能手機、平板電腦、便攜式膝上筆記本電腦、臺式計算機、智能音箱、智能可穿戴設備、智能語音交互設備、智能家電、車載終端等終端中的至少一種。

61.值得注意的是,服務器220能夠是獨立的物理服務器,也能夠是多個物理服務器構成的服務器集或者分布式系統,還能夠是提供云服務、云數據庫、云計算、云函數、云存儲、網絡服務、云通信、中間件服務、域名服務、安全服務、cdn(content delivery network,內容分發網絡)以及大數據和人工智能平臺等基礎云計算服務的云服務器。

62.可選地,服務器220還可以實現為區塊鏈系統中的節點。

63.值得注意的是,上述通信網絡230可以實現為有線網絡,也可以實現為無線網絡,且通信網絡230可以實現為局域網、城域網或廣域網中的任意一種,本技術實施例對此不加以限定。

64.值得注意的是,上述服務器220實現的韻律邊界標注服務也可以實現在終端210中,本實施例對此不加以限定。

65.需要說明的是,本技術所涉及的信息(包括但不限于用戶設備信息、用戶個人信息等)、數據(包括但不限于用于分析的數據、存儲的數據、展示的數據等)以及信號,均為經用戶授權或者經過各方充分授權的,且相關數據的收集、使用和處理需要遵守相關國家和地區的相關法律法規和標準。例如,本技術中涉及到的目標文本和目標音頻都是在充分授權的情況下獲取的。

66.結合上述介紹和實施環境,對本技術實施例提供的韻律邊界標注方法進行說明,圖3是本技術一個示例性實施例提供的一種韻律邊界標注方法的流程圖,以該方法應用于如圖2所示的服務器220中為例進行說明,該方法包括:

67.步驟301,獲取目標文本和目標音頻。

68.目標文本的文本內容與目標音頻的音頻內容匹配,目標文本為待進行韻律邊界識別的文本。

69.可選地,目標文本是中文文本、英文文本等文本中的至少一種,本技術實施例對目標文本的語言的種類不加以限定。可選地,目標文本中的文本內容可以包括字符和標點符

號,也可以只包括字符,示意性的,目標文本可以是“你好!歡迎你~”,也可以是“你好歡迎你”。

70.可選地,目標音頻是普通話音頻、其他中文方言音頻、英文英式發音音頻、英文美式發音音頻等中的其中一種,本技術實施例對目標音頻的語言的種類不加以限定。

71.可選地,目標文本的文本內容與目標音頻的音頻內容是匹配的,示意性的,以目標文本實現為中文文本、目標音頻實現為普通話音頻為例進行說明,若目標文本的文本內容是“你好!歡迎你!”,則目標音頻中的音頻內容是用普通話讀出的“你好!歡迎你!”。值得注意的是,一種語言的目標文本可以有多個與其匹配的目標音頻,其中,多個目標音頻的語言的種類是不同的,示意性的,目標文本的文本內容是“你好!歡迎你!”,則目標音頻中的音頻內容可以是用普通話讀出的“你好!歡迎你!”,也可以是用粵語方言讀出的“你好!歡迎你!”。根據需要訓練的語音合成系統的語言種類,可以選擇不同的目標音頻,示意性的,如果需要獲取的是訓練普通話語音合成系統的數據,則中文文本對應的目標音頻實現為普通話音頻。

72.可選地,目標文本中包括至少一段需要進行韻律邊界識別的連續的字符。

73.可選地,韻律邊界識別主要是通過字符或者連續的字符組合對應的語義信息、字符與字符之間的發音停頓時間、單個字符的發音時間、單個字符的發音高低、連續的字符組合的發音的變化等信息來判斷字符與字符之間的韻律邊界的類型。

74.上述韻律邊界包括字邊界、語法詞邊界、韻律詞邊界、韻律短語邊界、語調短語邊界中的至少一種:

75.1、字邊界是對目標文本中的字符進行劃分的邊界。

76.可選地,字邊界是目標文本中相鄰的字符與字符之間的邊界。

77.示意性的,中文文本中的字符是文本中的每個漢字,則中文文本中字邊界為漢字與漢字之間的邊界。

78.可選地,目標文本中的每個字符都對應有一個字邊界標識,其中,字邊界標識用于指示其對應的字符與下一字符之間的邊界為字邊界。示意性的,“我們”中的“我”對應有字邊界標識,則代表“我”和“們”之間的邊界為字邊界。

79.可選地,字邊界標識的標注方法包括以下方法中的至少一種:

80.方法一、上述字邊界標識為基礎標識,語法詞邊界標識、韻律詞邊界標識、韻律短語邊界標識、語調短語邊界標識可以對字邊界標識進行修改。

81.示意性的,以目標文本實現為中文文本為例進行說明,在對中文文本進行韻律邊界標注時,首先給中文文本中的每個漢字標注一個字邊界標識,然后繼續韻律邊界識別過程,若識別出其中相鄰的a漢字和b漢字之間的邊界為語法詞邊界,則對a漢字的字邊界標識進行修改,修改為語法詞邊界標識。

82.方法二、上述字邊界為給目標文本標注完語法詞邊界標識、韻律詞邊界標識、韻律短語邊界標識、語調短語邊界標識后自動為目標文本分配的標識。

83.示意性的,以目標文本實現為中文文本為例進行說明,識別中文文本的語法詞邊界、韻律詞邊界、韻律短語邊界、語調短語邊界,根據識別到的語法詞邊界、韻律詞邊界、韻律短語邊界、語調短語邊界,對中文文本中的漢字標注相應的語法詞邊界標識、韻律詞邊界標識、韻律短語邊界標識和語調短語邊界標識,最后,未被標注的漢字則標注字邊界標識。

84.例如:在中文文本“我們提出”中,識別出“們”和“提”之間的邊界為語法詞邊界,則對“們”標注語法詞邊界標識,“出”與下一個字符之間的邊界為韻律詞邊界,則對“出”標注韻律詞邊界標識。其中,“我”和“提”還未進行標注,則對“我”和“提”標注字邊界標識。

85.2、語法詞邊界是對目標文本中的語法詞進行劃分的邊界。

86.可選地,語法詞為目標文本中一個或者一個以上的字符組成具有獨立語義的詞,示意性的,以目標文本實現為中文文本為例進行說明,語法詞為中文文本中詞的基本單位,用于確定每個詞中各個字的發音,區分多音字。

87.可選的,若識別出相鄰的c字符與d字符之間的邊界為語法詞邊界,則對c字符標注語法詞邊界標識。可選地,對c字符標注語法詞邊界標識的方法包括以下方法中的至少一種:

88.方法一、若c字符未標注字邊界標識,則直接對c字符標注語法詞邊界標識。

89.示意性的,中文文本“我們提出”中“們”和“提”之間的邊界為語法詞邊界,直接對“們”標注語法詞邊界標識。

90.方法二、若c字符標注有字邊界標識,則將該字邊界標識修改為語法詞邊界標識。

91.示意性的,中文文本“我們提出”中“們”和“提”之間的邊界為語法詞邊界,且“們”上標注有字邊界標識,則將“們”的字邊界標識修改為語法詞邊界標識。

92.3、韻律詞邊界是對目標文本中的韻律詞進行劃分的邊界。

93.可選地,韻律詞為一個或者一個以上的語法詞組成的發音無停頓的詞,也就是說,韻律詞是由一個或者一個以上連續發音的語法詞組成的詞。

94.可選的,若識別出相鄰的e字符與f字符之間的邊界為韻律詞邊界,則對e字符標注韻律詞邊界標識。可選地,對e字符標注韻律詞邊界標識的方法包括以下方法中的至少一種:

95.方法一、若e字符未標注字邊界標識,則直接對f字符標注韻律詞邊界標識。

96.示意性的,中文文本“我們提出用”中“出”和“用”之間的邊界為韻律詞邊界,直接對“出”標注韻律詞邊界標識。

97.方法二、若e字符標注有字邊界標識,則將該字邊界標識修改為韻律詞邊界標識。

98.示意性的,中文文本“我們提出用”中“出”和“用”之間的邊界為韻律詞邊界,且“出”上標注有字邊界標識,則將“出”的字邊界標識修改為韻律詞邊界標識。

99.4、韻律短語邊界是對目標文本中的韻律短語進行劃分的邊界。

100.可選地,韻律短語為一個或者一個以上的韻律詞組成的不具有完整語法結構的短語。

101.可選的,若識別出相鄰的g字符與h字符之間的邊界為韻律短語邊界,則對g字符標注韻律短語邊界標識。可選地,對g字符標注韻律短語邊界標識的方法包括以下方法中的至少一種:

102.方法一、若g字符未標注字邊界標識,則直接對g字符標注韻律短語邊界標識。

103.示意性的,中文文本“我們提出用自動標注器標注韻律”中“器”和“注”之間的邊界為韻律短語邊界,直接對“器”標注韻律短語邊界標識。

104.方法二、若g字符標注有字邊界標識,則將該字邊界標識修改為韻律短語邊界標識。

105.示意性的,中文文本“我們提出用自動標注器標注韻律”中“器”和“注”之間的邊界為韻律短語邊界,且“器”上標注有字邊界標識,則將“器”的字邊界標識修改為韻律短語邊界標識。

106.5、語調短語邊界是對目標文本中的語調短語進行劃分的邊界。

107.可選地,語調短語為一個或者一個以上的韻律短語組成的具有完成語法結構短語。示意性的,在中文文本中,語調短語為聽感上可獨立成句的一段發音,語調短語一般對應句法上的句子。

108.可選的,若識別出相鄰的i字符與j字符之間的邊界為語調短語邊界,則對i字符標注語調短語邊界標識。可選地,標注語調短語邊界標識的過程包括以下方法中的至少一種:

109.方法一、若i字符未標注字邊界標識,則直接對i字符標注語調短語邊界標識。

110.示意性的,中文文本“我們提出用自動標注器標注韻律其中”中“律”和“其”之間的邊界為語調短語邊界,直接對“律”標注語調短語邊界標識。

111.方法二、若i字符標注有字邊界標識,則將該字邊界標識修改為語調短語邊界標識。

112.示意性的,中文文本“我們提出用自動標注器標注韻律其中”中“律”和“其”之間的邊界為語調短語邊界,且“律”上標注有字邊界標識,則將“律”的字邊界標識修改為韻律短語邊界標識。

113.可選地,獲取目標文本和目標音頻的方式包括以下方式中的至少一種:

114.1、獲取目標文本;基于目標文本,獲取與目標文本的文本內容匹配的目標音頻。

115.示意性的,服務器獲取需要進行韻律邊界標注的目標文本,并獲取通過終端錄制的人工朗讀目標文本的音頻,作為目標音頻。

116.2、獲取目標音頻;基于目標音頻,獲取與目標音頻的音頻內容匹配的目標文本。

117.示意性的,服務器獲取到需要進行韻律邊界標注的目標音頻后,通過語音識別系統將目標音頻轉化成無韻律標注的目標文本;或者,服務器獲取需要進行韻律邊界標注的目標音頻,并獲取通過終端接收的人工識別目標音頻的文本內容,作為目標文本。

118.值得注意的是,上述獲取目標文本和目標音頻的方式僅為示意性的舉例,本技術實施例對此不加以限定。

119.步驟302,以字符為分析粒度提取目標文本的文本韻律特征表示。

120.可選地,文本韻律特征表示為包含有目標文本的上下文信息的特征表示。

121.在一些可選的實施例中,其中,上下文信息包括:上下文語義信息、上下文位置信息、上下文字符長度信息等中的其中一種,本實施對此不加以限定。

122.其中,字符可以實現為中文文本中的每個漢字,還可以實現為英文文本中的每個單詞,示意性的,以目標文本實現為中文文本為例進行說明,對中文文本中的每個漢字進行分析,提取每個漢字包含的上下文特征,將包含有上下文特征的特征表示作為文本韻律特征表示;以目標文本實現為英文文本為例進行說明,對英文文本中的每個單詞進行分析,提取每個單詞包含的上下文特征,將包含有上下文特征的特征表示作為文本韻律特征表示。

123.可選地,在提取目標文本的文本韻律特征表示之前還包括對目標文本的預處理,其中,預處理的方法包括以下方法中的至少一種:

124.1、去冗余信息處理。

125.示意性的,目標文本中可能包含一些不必要的空格、重復的標點符號、不必要的重復的字等冗余信息,則在提取目標文本的文本韻律特征表示之前可以對這些冗余信息進行檢查,并刪除這些冗余信息。

126.2、錯別字的糾正處理。

127.示意性的,目標文本中可能包含有錯別字,則需要對錯別字進行檢測,然后改正目標文本中的錯別字。例如:目標文本中的一句話是“案件的真想是什么?”,其中的“想”是錯別字,“真想”應該是“真相”,則需要將這句話中的“想”改為“相”;或者,目標文本中的一句話是“i don't like apbles.”,其中,“apbles”是錯誤的拼寫,則需要將這句話中的“apbles”改為“apples”。

128.3、詞性標記處理。

129.可選地,對目標文本中的詞進行詞性的標記,其中,詞性是指詞的詞類,包括:名詞、形容詞、動詞、冠詞、連詞、代詞、副詞、數詞、介詞、感嘆詞等。

130.示意性的,以目標文本實現為中文文本為例進行說明,對目標文本進行分詞處理得到多個分詞;獲取標注了詞性的詞語庫;將目標文本的多個分詞與標注了詞性的詞語庫進行匹配,獲取目標文本的詞性標記結果。

131.4、預分句處理。

132.可選的,若目標文本中的文本內容包括字符和標點符號,示意性的,可以按照句號對目標文本中的文本內容進行分句處理,將目標文本中的文本內容分為多個目標語句。

133.5、標點符號處理。

134.可選地,目標文本中可能包含標點符號,則可以對這些標點符號進行標記,或者,將這些標點符號從目標文本中刪除。

135.需要說明的是,上述預處理的方法僅為示意性的舉例,本技術實施例對此不加以限定。

136.步驟303,以發聲內容為分析基礎提取目標音頻的音頻韻律特征表示。

137.可選地,音頻韻律特征表示為包含有目標音頻的韻律邊界相關信息的特征表示。

138.可選地,音頻韻律特征表示包括:包含有目標音頻的全局韻律邊界相關信息的特征表示,或者,包含有目標音頻的局部韻律邊界相關信息的特征表示,本技術實施例對此不加以限定。

139.可選地,提取目標音頻的音頻韻律特征表示還包括:提取目標音頻的目標特征表示;基于提取到的目標特征表示,提取目標音頻的音頻韻律特征表示。

140.其中,目標特征表示包括:時域特征表示、頻域特征表示、音高特征表示、音強特征表示、音長特征表示、音特征表示等中的至少一種,上述時域特征表示、頻域特征表示、音高特征表示、音強特征表示、音長特征表示、音特征表示等都是用于指示目標音頻的發聲內容,本技術實施例對目標特征表示的數量和種類不加以限定。

141.示意性的,目標特征表示可以實現為目標音頻的頻域特征表示和音高特征表示,則提取目標音頻的音頻韻律特征表示的過程包括:提取目標音頻的頻域特征表示和音高特征表示;基于頻域特征表示和音高特征表示,提取目標音頻的音頻韻律特征表示。

142.值得注意的是,上述步驟302和步驟303可以為兩個并列步驟,也可以有先后順序,本技術對此并不限定,即,可以先執行步驟302再執行步驟303,也可以先執行步驟303再執

行步驟302,還可以同步執行步驟302和步驟303。

143.步驟304,將文本韻律特征表示和音頻韻律特征表示進行融合,得到融合韻律特征表示。

144.在一些可選的實施例中,上述得到融合韻律特征表示的方法,包括以下方法中的至少一種:

145.1、將文本韻律特征表示和音頻韻律特征表示直接連接,得到融合韻律特征表示。則融合后的融合特征表示的維度是文本韻律特征表示的維度與音頻韻律特征表示的維度的和。

146.示意性的,若文本韻律特征表示為a,維度為a;音頻韻律特征表示為b,為度為b,則融合后的融合韻律特征的維度為a+b。

147.2、以文本韻律特征表示的維度為目標,對音頻韻律特征表示進行維度轉換;將維度轉換后的音頻韻律特征表示與文本韻律特征表示進行融合,得到融合韻律特征表示。

148.可選地,對音頻韻律特征表示進行維度轉換,使其與文本韻律特征表示的維度相同,將進行維度轉換后的音頻韻律特征表示和文本韻律特征表示進行融合,得到融合韻律特征表示。示意性的,若文本韻律特征表示為c,維度為c;音頻韻律特征表示為d,維度為d,則融合后的融合韻律特征的維度為c。

149.需要說明的是,上述得到融合韻律特征表示的方法僅為示意性的舉例,本技術實施例對此不加以限定。

150.步驟305,基于融合韻律特征表示對目標文本進行韻律邊界預測,得到與目標文本等長的韻律邊界標注結果。

151.韻律邊界標注結果中包括以字符為粒度在目標文本上的進行劃分的韻律邊界。

152.可選的,基于融合韻律特征表示對目標文本進行韻律邊界預測,獲取韻律邊界標注序列,其中,韻律邊界標注序列與目標文本中的字符一一對應;將韻律邊界標注序列與目標文本中的字符對齊,獲取韻律邊界標注結果。

153.示意性的,請參考圖4,其示出了一種韻律邊界標注結果400,“我”對應的韻律邊界標注為“cc”,指示的是“我”與“們”之間是字邊界;“們”對應的韻律邊界標注為“lw”,指示的是“們”與“提”之間是語法詞邊界;“出”對應的韻律邊界標注為“pw”,指示的是“出”與“用”之間是韻律詞邊界;“器”對應的韻律邊界標注為“pph”,指示的是“器”與“標”之間是韻律短語邊界;“律”對應的韻律邊界標注為“iph”,指示的是“律”與下一個字之間是語調短語邊界。

154.需要說明的是,上述字邊界、語法詞邊界、韻律詞邊界、韻律短語邊界、語調短語邊界是層層遞進的,例如:目標文本中標注韻律短語邊界的位置也必然是韻律詞邊界、語法詞邊界、字邊界的位置。則可以根據目標文本中的韻律邊界,對目標文本進行韻律分層。示意性的,請參考圖5,其示出了圖4中目標文本的韻律分層結果500,其中,語調短語包括:“我們提出用自動標注器標注韻律”;韻律短語包括:“我們提出用自動標注器”、“標注韻律”;韻律詞包括:“我們提出”、“用自動標注器”、“標注韻律”;語法詞包括:“我們”、“提出”、“用”、“自動”、“標注器”、“標注”、“韻律”;字包括:“我”、“們”、“提”、“出”、“用”、“自”、“動”、“標”、“注”、“器”、“標”、“注”、“韻”、“律”。

155.綜上所述,本技術實施例提供的韻律邊界標注方法,通過將目標文本的文本韻律

特征表示和目標音頻的音頻韻律特征表示進行融合,得到融合韻律特征表示,對融合韻律特征表示進行韻律邊界預測,由于音頻韻律特征表示中包含有韻律邊界信息,從而提高了對目標文本進行韻律邊界標注的準確度;且以字符為粒度對目標文本進行分析和預測韻律邊界,提升了韻律邊界標注結果的細粒度,從而進一步提高了對目標文本進行韻律邊界標注的準確度。

156.本技術實施例提供的韻律邊界標注方法,對目標文本中的每個字符都進行了韻律邊界標注,且標注的韻律邊界包括字邊界、語法詞邊界,韻律詞邊界,韻律短語邊界,語調短語邊界等中的至少一種,從而提升了韻律標注結果的細粒度。

157.在一些可選的實施例中,上述文本韻律特征表示是通過預訓練的文本編碼器提取的特征;以及,上述音頻韻律特征表示是通過預訓練的音頻編碼器提取的特征。圖6是本技術一個示例性實施例提供的一種韻律邊界標注方法的流程圖,以該方法應用于如圖2所示的服務器220中為例進行說明,該方法包括:

158.步驟601,獲取目標文本和目標音頻。

159.目標文本的文本內容與目標音頻的音頻內容匹配,目標文本為待進行韻律邊界識別的文本。

160.可選地,目標文本是中文文本、英文文本等文本中的至少一種,本技術實施例對目標文本的語言的種類不加以限定。目標音頻是普通話音頻、其他中文方言音頻、英文英式發音音頻、英文美式發音音頻等中的其中一種,本技術實施例對目標文本和目標音頻的語言的種類不加以限定。

161.示意性的,以目標文本實現為中文文本,目標音頻實現為普通話音頻為例進行說明,服務器通過終端獲取目標文本;以及,獲取通過終端錄制說話人對目標文本進行普通話朗讀的音頻數據,從而獲取目標音頻。或者,服務器從普通話音頻數據集中獲取目標音頻;以及,對象通過人工識別的方式將目標音頻中的內容轉化成中文文本數據,將該中文文本數據輸入至終端后,終端將該中文文本數據上傳至服務器,作為目標文本。

162.步驟602,對目標文本進行字符分割,得到目標文本中的多個字符數據。

163.可選地,字符是指從語義的角度,目標文本中可以被分割的最小單位。例如:中文文本中的字和英文文本中的單詞,都是單獨的一部分,且為組成一句話的最小單位。

164.示意性的,若目標文本實現為中文文本,則對目標文本進行分字處理,得到目標文本中的多個字的集合。例如:中文文本為“我們提出用自動標注器標注韻律”,則將這句話切分成每個單獨的漢字的集合,即“我”、“們”、“提”、“出”、“用”、“自”、“動”、“標”、“注”、“器”、“標”、“注”、“韻”、“律”這14個漢字的集合。

165.示意性的,若目標文本實現為英文文本,則對目標文本進行分詞處理,得到目標文本中的多個單詞的集合。例如:英文文本為“we propose to label prosody with automatic annotator”,則將這句話按照英文中的每個單詞之間的空格切分成每個單獨的單詞的集合,即“we”、“propose”、“to”、“label”、“prosody”、“with”、“automatic”、“annotator”這8個單詞的集合。

166.步驟603,提取多個字符數據分別對應的字向量。

167.可選地,上述字向量是指字符數據中各個字符對應的原始向量表示。

168.示意性的,以目標文本實現為中文文本進行說明,提取中文文本中每個漢字對應

的原始向量表示;或者,通過查詢字向量表將目標文本中的每個漢字轉換成一維向量,也即字向量。

169.步驟604,將字向量輸入文本編碼器,輸出目標文本的文本韻律特征表示。

170.可選地,上述文本韻律特征表示包括:字符數據對應的文本向量、位置向量等中的至少一種。

171.示意性,以目標文本實現為中文文本為例進行說明,將字向量輸入文本編碼器中,獲取該字向量對應的文本向量,其中,文本向量中包括中文文本的全局語義信息以及該字向量對應的漢字的語義信息,文本向量用于指示該字向量對應的漢字在中文文本中的具體語義;以及,基于中文文本,獲取該漢字對應的位置向量,其中,位置向量用于指示該字向量對應的漢字在中文文本中的位置信息;最后,將字向量、文本向量、位置向量的和,作為該漢字對應的字韻律特征表示;輸出中文文本中的每個漢字對應的字韻律特征表示的集合,作為中文文本的文本韻律特征表示,或者將中文文本中的每個漢字對應的字韻律特征表示進行拼接,作為中文文本的文本韻律特征表示。

172.可選地,上述中文文本中每個漢字對應的字韻律特征表示的長度是相同的。

173.在一些可選的實施例中,上述字韻律特征表示可以實現為加權的字韻律特征表示,可選地,字韻律特征表示的加權方法包括:基于字符對應的字向量,查詢字向量權重表;獲取該字向量對應的權重;基于該權重,將字向量對應的字韻律特征表示進行加權處理,得到加權的字韻律特征表示。其中,字向量權重表用于指示字向量對應的字符在目標文本中的重要性。

174.值得注意的是,上述文本編碼器是通過文本語料庫預訓練得到的編碼器。

175.示意性的,文本編碼器包括:長短期記憶網絡(long short-term memory,lstm)、雙向編碼器表征(bidirectional encoderrepresentation from transformers,bert)模型、生成式預訓練模型(gererate pre-training model,gpt)、roberta模型等中的至少一種,本技術實施例對此不加以限定。下面以文本編碼器實現為bert模型進行說明。

176.示意性的,bert模型是經過預訓練的文本編碼器,若目標文本實現為中文文本,則bert模型的預訓練數據集為中文語料庫。可選地,基于bert模型的預訓練過程確定上述文本向量的初始取值參數。

177.步驟605,提取目標音頻的頻域特征表示和音高特征表示。

178.頻域特征表示和音高特征表示用于指示目標音頻的發聲內容。

179.示意性,頻域特征表示包括:濾波器組(filter bank,fbank)特征、梅爾頻率倒譜系數(mel frequency cepstrum coefficient,mfcc)特征等中的至少一種,本技術實施例對此不加以限定。

180.示意性的,提取頻域特征表示的具體過程如下:

181.可選地,將目標音頻進行分幀處理,獲取多個時間幀;針對目標音頻中的每個時間幀分別提取其對應的子頻域特征表示;將目標音頻中所有時間幀對應的子頻域特征表示進行拼接,獲取目標音頻的頻域特征表示,或者,將子頻域特征表示的集合作為目標音頻的頻域特征表示。

182.示意性的,提取音高特征表示的具體過程如下:

183.可選地,將目標音頻進行分幀處理,獲取多個時間幀;針對目標音頻中的每個時間

幀分別提取其對應的子音高特征表示;將目標音頻中所有時間幀對應的子音高特征表示進行拼接,獲取目標音頻的音高特征表示,或者,將子音高特征表示的集合作為目標音頻的音高特征表示。

184.步驟606,對頻域特征表示和音高特征表示進行拼接,得到目標特征表示。

185.可選地,上述得到目標特征表示的方式包括以下方式中的至少一種:

186.1、對頻域特征表示和音高特征表示進行加權求和,得到目標特征表示;

187.2、獲取頻域特征表示和音高特征表示的乘積,作為目標特征表示;

188.3、獲取頻域特征表示和音高特征表示的笛卡爾積,作為目標特征表示;

189.4、將頻域特征表示和音高特征表示的集合作為目標特征表示。

190.值得注意的是,上述得到目標特征表示的方法僅為示意性的舉例,本技術實施例對此不加以限定。

191.步驟607,將目標特征表示輸入音頻編碼器,輸出得到目標音頻的音頻韻律特征表示。

192.其中,音頻編碼器是通過語音數據集預訓練得到的編碼器。

193.可選地,上述得到目標音頻的音頻韻律特征表示的方法包括以下方法中的至少一種:

194.1、將目標特征表示輸入音頻編碼器,得到第一語音后驗概率圖,第一語音后驗概率圖用于指示目標音頻的音素級別后驗概率;基于第一語音后驗概率圖,輸出得到目標音頻的音頻韻律特征表示。

195.可選地,輸出第一語音后驗概率圖作為目標音頻的音頻韻律特征表示。

196.示意性的,上述音頻編碼器可以實現為基于音素級別的語音后驗概率圖提取器,則將目標特征表示輸入到基于音素級別的語音后驗概率圖提取器中,輸出得到第一語音后驗概率圖,作為目標音頻的音頻韻律特征表示。

197.其中,在第一語音后驗概率圖中,橫坐標用于指示目標音頻的時間線,縱坐標用于指示音素的類別,圖中每個坐標點用于指示在給定時間點出現該類別音素的后驗概率大小,在每個坐標點處的顏越深,概率越大。

198.示意性的,若目標音頻實現為普通話音頻,則基于音素級別的語音后驗概率圖提取器在普通話語音數據集上進行預訓練,下面對基于音素級別的語音后驗概率圖提取器的預訓練過程進行說明:

199.其中,預訓練的目標為與上下文無關的218個幀級別音素。

200.示意性的,將普通話語音數據集中的語音輸入高斯混合模型-隱馬爾可夫模型(gaussian mixture model-hidden markov model,gmm-hmm)中獲取普通話語音數據集對應的音素;將該音素作為訓練數據,交叉熵作為損失函數訓練基于音素級別的語音后驗概率圖提取器。

201.2、將目標特征表示輸入音頻編碼器,得到第二語音后驗概率圖,第二語音后驗概率圖用于指示目標音頻的字級別后驗概率;基于第二語音后驗概率圖,輸出得到目標音頻的音頻韻律特征表示。

202.上述音頻編碼器可以實現為基于字級別的語音識別模型,可選地,將目標特征表示輸入到基于字級別的語音識別模型中,輸出得到第二語音后驗概率圖,作為目標音頻的

音頻韻律特征表示。

203.示意性的,以目標文本實現為中文文本進行說明,其中,在第二語音后驗概率圖中,橫坐標用于指示目標音頻的時間線,縱坐標用于指示漢字的種類,圖中每個坐標點用于指示在給定時間點出現該漢字的后驗概率大小,在每個坐標點處的顏越深,概率越大。

204.在一些可選的實施例中,將上述目標音頻分割為多個音頻片段分別進行分析,其中,目標特征表示中包括目標音頻片段對應的片段特征表示,則得到第二語音后驗概率圖的過程還包括:

205.將片段特征表示輸入音頻編碼器,得到片段特征表示對應的后驗概率子圖;將多個音頻片段分別對應的后驗概率子圖進行整合,得到第二語音后驗概率圖。

206.示意性的,若目標音頻實現為普通話音頻,則基于字級別的語音識別模型在普通話語音數據集上進行預訓練,可選地,連接時序分類(connectionist temporal classification,ctc)作為損失函數端到端訓練對基于字級別的語音識別模型進行預訓練,預訓練的過程如下:

207.將普通話語音數據集中的語音輸入基于字級別的語音識別模型,獲取預測數據;基于預測數據和預先獲取的真實數據,得到ctc損失;基于ctc損失對基于字級別的語音識別模型進行訓練。

208.步驟608,將文本韻律特征表示和音頻韻律特征表示進行融合,得到融合韻律特征表示。

209.可選地,通過注意力機制對音頻韻律特征表示進行維度轉換,使其與文本韻律特征表示的維度相同,將進行維度轉換后的音頻韻律特征表示和文本韻律特征表示進行融合,得到融合韻律特征表示。

210.示意性的,上述文本韻律特征表示和音頻韻律特征表示實現為文本韻律特征向量和音頻韻律特征向量,將文本韻律特征向量和音頻韻律特征向量輸入到多模態融合模型中獲取融合韻律特征向量,下面對獲取融合韻律特征向量的過程進行說明:

211.請參考圖7,多模態融合模型700中包括第一網絡層710和第二網絡層720,第一網絡層710中包括多頭自注意力層、第一前向傳播層、第一線性層;第二層網絡層720中包括多頭交叉注意力層。

212.首先將音頻韻律特征向量711輸入第一網絡層710中,輸出得到與文本韻律特征向量721維度相同的音頻韻律特征向量712;將與文本韻律特征向量721維度相同的音頻韻律特征向量712和文本韻律特征向量721輸入第二網絡層720中,其中,在多頭交叉注意力層中對與文本韻律特征向量721維度相同的音頻韻律特征向量712和文本韻律特征向量721進行融合計算,文本韻律特征向量721作為查詢值(query),與文本韻律特征向量721維度相同的音頻韻律特征向量712作為關鍵值(key)和值(value),具體計算公式如下:

213.公式一:q

x

,ko,vo=wqx,wko,w

vo214.公式二:

215.公式一中,用o=[o1,

…

,o

t

]∈r

t

×d和x=[x1,

…

,x

t

]∈rn×d分別表示多頭交叉注意力層的音頻和文本端輸入;q

x

,ko,vo分別表示文本端的query輸入、音頻端key輸入、音頻端的value輸入;wq,wk,wv分別表示q

x

,ko,vo的可訓練的矩陣。

[0216]

公式二中,h∈rn×d是多頭交叉注意力層的輸出,即融合韻律特征向量;d表示融合韻律特征向量的維度;softmax為激活函數。

[0217]

最后,輸出得到的h∈rn×d,作為融合韻律特征向量722。

[0218]

步驟609,基于融合韻律特征表示對目標文本進行韻律邊界預測,確定目標文本中的字符對應的韻律邊界類型。

[0219]

其中,韻律邊界類型包括字(cc)邊界、語法詞(lw)邊界、韻律詞(pw)邊界、韻律短語(pph)邊界、語調短語(iph)邊界中的至少一種,本技術實施例對此不加以限定。

[0220]

步驟610,以韻律邊界類型對目標文本中的字符進行標注,得到與目標文本等長的韻律邊界標注結果。

[0221]

韻律邊界標注結果中包括以字符為粒度在目標文本上的進行劃分的韻律邊界。

[0222]

可選的,以韻律邊界類型對目標文本中的字符進行標注,獲取韻律邊界標注序列,其中,韻律邊界標注序列與目標文本中的字符一一對應;將韻律邊界標注序列與目標文本中的字符對齊,獲取韻律邊界標注結果。

[0223]

示意性的,請參考圖4,“我”對應的韻律邊界標識為“cc”,則代表“我”與“們”之間的韻律邊界類型為字邊界。

[0224]

在一個可選的實施例中,上述得到與目標文本等長的韻律邊界標注結果的方法,還包括:

[0225]

基于文本韻律特征表示對目標文本進行韻律邊界預測,得到與目標文本等長的韻律邊界文本特征預測結果;基于音頻韻律特征表示對目標文本進行韻律邊界預測,得到與目標文本等長的韻律邊界音頻特征預測結果;基于韻律邊界文本特征預測結果和韻律邊界音頻特征預測結果,得到與目標文本等長的韻律邊界標注結果。

[0226]

示意性的,分別獲取文本韻律特征表示預測的韻律邊界文本特征標注結果和音頻韻律特征表示預測的韻律邊界音頻特征標注結果,選擇其中韻律自然度高的標注結果作為最終的韻律邊界標注結果。

[0227]

在一個可選的實施例中,上述得到與目標文本等長的韻律邊界標注結果的方法,還包括:

[0228]

獲取目標文本和目標音頻;響應于目標文本中的字符數量小于或者等于預設字符閾值,則提取目標文本的文本韻律特征表示;基于文本韻律特征表示對目標文本進行韻律邊界預測,得到與目標文本等長的韻律邊界預測結果。或者,響應于目標文本中的字符數量大于預設字符閾值,則提取目標文本的文本韻律特征表示以及提取目標音頻的音頻韻律特征表示;將文本韻律特征表示和音頻韻律特征表示進行融合,得到融合韻律特征表示;基于融合韻律特征表示對目標文本進行韻律邊界預測,得到與目標文本等長的韻律邊界標注結果。

[0229]

也就是說,在對文本進行韻律邊界預測之前,首先判斷文本中的字符的數量,若字符的數量較少,小于或者等于預設的字符閾值,則代表該文本中的韻律邊界較為簡單,可直接通過對文本進行語義分析獲取韻律邊界標注結果;若文本中的字符的數量較多,大于預設的字符閾值,則通過對文本的語義信息和音頻中的韻律邊界相關信息進行聯合分析獲取韻律邊界標注結果。

[0230]

綜上所述,本技術實施例提供的韻律邊界標注方法,通過將目標文本的文本韻律

特征表示和目標音頻的音頻韻律特征表示進行融合,得到融合韻律特征表示,對融合韻律特征表示進行韻律邊界預測,由于音頻韻律特征表示中包含有韻律邊界信息,從而提高了對目標文本進行韻律邊界標注的準確度;且以字符為粒度對目標文本進行分析和預測韻律邊界,提升了韻律邊界標注結果的細粒度,從而進一步提高了對目標文本進行韻律邊界標注的準確度。

[0231]

本技術實施例提供的韻律邊界標注方法,對目標文本中的每個字符都進行了韻律邊界標注,且標注的韻律邊界包括字邊界、語法詞邊界,韻律詞邊界,韻律短語邊界,語調短語邊界等中的至少一種,從而提升了韻律標注結果的細粒度。

[0232]

本技術實施例提供的韻律邊界標注方法,通過預訓練的文本編碼器和預訓練的音頻編碼器分別提取目標文本的文本韻律特征表示和目標音頻的音頻韻律特征表示,提升了韻律標注方法的準確率和泛化性。

[0233]

圖8是本技術一個示例性實施例提供的一種韻律邊界標注方法的流程圖,以該方法應用于如圖2所示的服務器220中為例進行說明,該方法包括:

[0234]

步驟801,獲取候選文本和預設語句庫。

[0235]

候選文本中包括多個目標語句,預設語句庫中包括多個預設語句。

[0236]

示意性的,預設目標文本可能是長文本,則其中包含有多條完整語句;預設語句庫中的預設語句包括經常會用到的語句、日常固定發音節奏的語句(也即,韻律邊界標注基本不會有變化的語句)等。

[0237]

可選地,獲取預設目標文本還包括:對預設目標文本的分句處理。示意性的,預設目標文本中多個目標語句之間可能有明顯的分割符號(例如:句號,逗號,問號等標點符號),按照分割符號,對預設目標文本進行分句處理,獲取多個語句。

[0238]

可選地,對預設目標文本進行分句處理的同時,按照目標語句在預設目標文本中的前后位置對目標語句進行順序編號。

[0239]

步驟802,將多個目標語句分別與預設語句庫中的預設語句進行匹配,得到多個語句匹配結果。

[0240]

示意性的,將獲取的多個目標語句,分別與預設語句庫中的預設語句進行匹配。若某一目標語句為“你好!”,預設語句庫中存儲有“你好!”這句話和“你好!”這句話的韻律標注結果,則代表該目標語句匹配成功,可選地,一條目標語句必須所有的字符和標點符號與預設語句庫中預設語句的字符和標點符號一一對應,才代表該目標語句匹配成功,否則,匹配失敗。則當所有的目標語句匹配結束時,多個語句匹配結果分為匹配成功的目標語句和匹配失敗的目標語句。

[0241]

步驟803,對多個語句匹配結果進行篩選,得到候選文本中與預設語句庫中的預設語句匹配失敗的目標語句,作為目標文本。

[0242]

其中,目標文本為待進行韻律邊界識別的文本。

[0243]

示意性的,對多個語句匹配結果進行篩選,將其中所有的匹配失敗的目標語句作為篩選后的語句匹配結果,并將匹配失敗的目標語句按照編號順序重新組合,得到目標文本。

[0244]

可選地,將匹配成功的目標語句存儲在臨時存儲空間,當目標文本中的匹配失敗的目標語句的韻律邊界標注流程結束,則將匹配成功的目標語句與標注了韻律邊界的目標

語句按照語句編號順序進行拼接。

[0245]

步驟804,獲取與目標文本相匹配的音頻,作為目標音頻。

[0246]

示意性的,提取匹配失敗的目標語句對應的音頻數據,作為目標音頻。

[0247]

步驟805,獲取預設短語庫。

[0248]

預設短語庫中包括多個預設短語。

[0249]

示意性的,該預設短語包括固定韻律詞,常用韻律詞、特殊韻律詞等。

[0250]

步驟806,將目標文本與預設短語庫中的預設短語進行匹配,得到參考匹配結果。

[0251]

示意性的,將目標文本與預設短語庫中的固定韻律詞,常用韻律詞、特殊韻律詞等進行匹配,得到標注了參考韻律邊界的目標文本,作為參考匹配結果。

[0252]

步驟807,以字符為分析粒度提取目標文本的文本韻律特征表示。

[0253]

可選地,對目標文本進行字符分割,得到目標文本中的多個字符數據;提取多個字符數據分別對應的字向量;將字向量輸入文本編碼器,輸出目標文本的文本韻律特征表示。其中,文本編碼器是通過文本語料庫預訓練得到的編碼器。

[0254]

步驟808,以發聲內容為分析基礎提取目標音頻的音頻韻律特征表示。

[0255]

可選地,提取目標音頻的頻域特征表示和音高特征表示;對頻域特征表示和音高特征表示進行拼接,得到目標特征表示;將目標特征表示輸入音頻編碼器,輸出得到目標音頻的音頻韻律特征表示。其中,音頻編碼器是通過語音數據集預訓練得到的編碼器。

[0256]

可選地,音頻編碼器是基于音素級別的編碼器,或者,音頻編碼器是基于字級別的編碼器。

[0257]

步驟809,將文本韻律特征表示和音頻韻律特征表示進行融合,得到融合韻律特征表示。

[0258]

可選地,通過注意力機制對音頻韻律特征表示進行維度轉換,使其與文本韻律特征表示的維度相同,將進行維度轉換后的音頻韻律特征表示和文本韻律特征表示進行融合,得到融合韻律特征表示。

[0259]

步驟810,基于融合韻律特征表示對目標文本進行韻律邊界預測,得到預測結果。

[0260]

可選地,基于融合韻律特征表示對目標文本進行韻律邊界預測,確定目標文本中的字符對應的韻律邊界類型;以韻律邊界類型對目標文本中的字符進行標注,得到與目標文本等長的預測結果。

[0261]

步驟811,基于預測結果與參考匹配結果,得到與目標文本等長的韻律邊界標注結果。

[0262]

韻律邊界標注結果中包括以字符為粒度在目標文本上的進行劃分的韻律邊界。

[0263]

在一些可選的實施例中,上述得到與目標文本等長的韻律邊界標注結果的方法包括:

[0264]

1、基于參考匹配結果對預測結果進行調整,得到與目標文本等長的韻律邊界標注結果。

[0265]

在一個可選的實施例中,參考匹配結果中包括韻律邊界參考標注序列,預測結果中包括韻律邊界預測標注序列;則對韻律邊界參考標注序列和韻律邊界預測標注序列進行比對,得到韻律邊界對比結果,其中,韻律邊界對比結果用于指示參考匹配結果和預測結果之前的差異性;基于韻律邊界對比結果,確定與目標文本等長的韻律邊界標注結果。

[0266]

可選地,預設短語庫中的預設短語對應有權重,韻律邊界參考標注序列中包括第一韻律邊界標識;則上述基于韻律邊界對比結果,得到與目標文本等長的韻律邊界標注結果,包括:

[0267]

響應于所述第一韻律邊界標識在所述韻律邊界預測標注序列中不存在,獲取目標文本中第一韻律邊界標識指示的短語;將短語與預設短語庫匹配,獲取與短語匹配的權重;響應于與短語匹配的權重達到預設權重閾值,更新韻律邊界預測標注序列,得到韻律邊界標注結果。

[0268]

示意性的,對比預測結果和參考匹配結果在韻律邊界標注序列上的差異;若在目標文本的某一位置,參考匹配結果的韻律邊界標識與預測結果不同,則獲取該位置上的韻律邊界標識指示的短語;查詢該短語在預設短語庫中對應的權重,若其權重達到預設的權重閾值,則將預測結果在該位置的韻律邊界標識替換成參考匹配結果在該位置的韻律邊界標識。

[0269]

2、選擇參考匹配結果或者預測結果,作為韻律邊界標注結果。

[0270]

示意性的,通過打分的方式,對參考匹配結果和測試結果進行打分,若參考匹配結果比測試結果得分高,則選擇參考匹配結果作為韻律邊界標注結果;若參考匹配結果比測試結果得分低,則選擇測試結果作為韻律邊界標注結果。

[0271]

綜上所述,本技術實施例提供的韻律邊界標注方法,通過將目標文本的文本韻律特征表示和目標音頻的音頻韻律特征表示進行融合,得到融合韻律特征表示,對融合韻律特征表示進行韻律邊界預測,由于音頻韻律特征表示中包含有韻律邊界信息,從而提高了對目標文本進行韻律邊界標注的準確度;且以字符為粒度對目標文本進行分析和預測韻律邊界,提升了韻律邊界標注結果的細粒度,從而進一步提高了對目標文本進行韻律邊界標注的準確度。

[0272]

本技術實施例提供的韻律邊界標注方法,對目標文本中的每個字符都進行了韻律邊界標注,且標注的韻律邊界包括字邊界、語法詞邊界,韻律詞邊界,韻律短語邊界,語調短語邊界等中的至少一種,從而提升了韻律標注結果的細粒度。

[0273]

本技術實施例提供的韻律邊界標注方法,通過預訓練的文本編碼器和預訓練的音頻編碼器分別提取目標文本的文本韻律特征表示和目標音頻的音頻韻律特征表示,提升了韻律標注方法的準確率和泛化性。

[0274]

本技術實施例提供的韻律邊界標注方法,在對目標文本進行韻律邊界預測之前,篩選出目標文本中與預設語句庫中的預設語句匹配失敗的語句進行分析,減少了韻律邊界標注方法的計算量;且通過對比參考匹配結果和預測結果,得到韻律邊界標注結果,提高了對目標文本進行韻律邊界標注的準確度。

[0275]

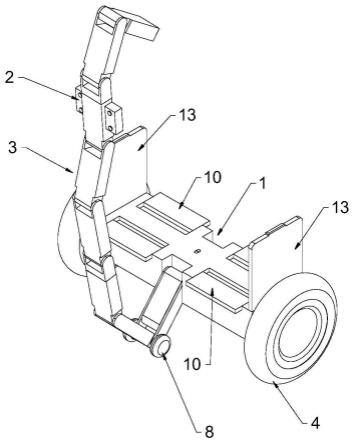

圖9是本技術一個示例性實施例提供的一種韻律邊界標注模型,請參考圖9,韻律邊界標注模型900中包括文本編碼器910、音頻編碼器920以及多模態融合解碼器930,用于對輸入的文本和音頻進行分析,得到與文本等長的韻律邊界標注結果。下面對通過韻律邊界標注模型900得到韻律邊界標注結果的具體實現步驟進行說明,如圖9所示:

[0276]

s1:服務器獲取在終端輸入的中文文本911“我們提出用自動標注器標注韻律”;以及,獲取通過終端錄制的說話人朗讀“我們提出用自動標注器標注韻律”的普通話音頻921。

[0277]

s2:將中文文本911分割為每個漢字組成的文本數據,獲取每個漢字組成的文本數

據的原始字向量;將中文文本911中所有漢字對應的字向量集合912輸入到文本編碼器910中,其中文本編碼器910實現為預訓練的中文bert編碼器,且文本編碼器910在300gb的新聞語料庫中進行預訓練;輸出得到固定長度的包含上下文特征的文本韻律特征向量913。

[0278]

示意性的,上述通過預訓練的中文bert編碼器提取文本韻律特征向量913的具體過程為:將字向量集合912輸入文本編碼器910中,獲取該字向量集合912對應的文本向量集合,其中,文本向量集合中包括中文文本911的全局語義信息以及該字向量集合912對應的漢字的語義信息,用于指示字向量集合912對應的漢字在中文文本911中的具體語義;以及,基于中文文本911,獲取該漢字對應的位置向量集合,其中,位置向量集合用于指示字向量集合912對應的漢字在中文文本911中的位置信息;最后,分別將每個漢字對應的字向量、文本向量、位置向量的和,作為該漢字對應的字韻律特征向量,且每個漢字的字韻律特征向量的長度是固定的;輸出中文文本911中的每個漢字對應的字韻律特征向量的集合,作為中文文本911的文本韻律特征向量913。

[0279]

s3:將普通話音頻921分割成多個時間幀,獲取每個時間幀的80維的fbank特征和3維的音高特征,將每個時間幀的80維的fbank特征和3維的音高特征進行拼接得到時間幀輸入特征;將普通話音頻921中所有的時間幀對應的時間幀輸入特征集合922輸入音頻編碼器920中。

[0280]

其中,音頻編碼器包括:基于卷積增強的轉換器(conformer)結構的語音后驗概率圖提取器、基于卷積神經網絡(convolutional neural network,cnn)結構的語音識別模型、基于conformer結構的語音識別模型。下面分別介紹這三個模型實現為音頻編碼器時,提取普通話音頻921的音頻韻律特征向量923的過程:

[0281]

(1)音頻編碼器920實現為基于conformer結構的語音后驗概率圖提取器。

[0282]

需要說明的是,基于conformer結構的語音后驗概率圖提取器是一個與說話人無關的幀級別分類器,會將每一個輸入時間幀映射為音素類別的后驗概率,其提取的語音后驗概率圖可以表示出音頻中各音素的持續時間和轉換信息。基于conformer結構的語音后驗概率圖提取器的模型結構由2個卷積層和12個conformer模塊組成。

[0283]

示意性的,將普通話音頻921中所有的時間幀對應的時間幀輸入特征集合922輸入音頻編碼器920中,通過2個卷積層和12個conformer模塊將每個時間幀對應的時間幀輸入特征映射為音素類別的時間幀后驗概率圖,其中,時間幀后驗概率圖的橫坐標用于指示每個時間幀的時間線,縱坐標用于指示音素的類別,圖中每個坐標點用于指示在給定時間點出現該類別音素的后驗概率大小,在每個坐標點處的顏越深,概率越大;獲取普通話音頻921中所有的時間幀對應的時間幀后驗概率圖的集合,作為普通話音頻921的音頻韻律特征向量923。

[0284]

值得注意的是,基于conformer結構的語音后驗概率圖提取器是在10k小時的wenetspeech數據集上預訓練過的音頻編碼器,下面對基于conformer結構的語音后驗概率圖提取器的預訓練過程進行說明:

[0285]

其中,預訓練的目標為與上下文無關的218個幀級別音素。

[0286]

示意性的,將10k小時的wenetspeech數據集中的語音輸入gmm-hmm模型中獲取10k小時的wenetspeech數據集對應的音素;將該音素作為訓練數據,交叉熵作為損失函數訓練基于conformer結構的語音后驗概率圖提取器。

[0287]

然而,上述語音后驗概率圖沒有考慮字級別的上下文特征,但字和詞級別的信息對韻律邊界的預測是很重要的。比如,序列“大學生物,必修課”和“大學生,務必修課”有相同的音素序列,但它們的韻律邊界不同。因此,只考慮音素信息的語音后驗概率圖有可能不能達到最優的預測效果。故,提供了將兩種字級別的語音識別模型用于韻律邊界預測,它們分別基于cnn和conformer結構。

[0288]

(2)音頻編碼器920實現為基于cnn結構的語音識別模型。

[0289]

需要說明的是,基于cnn結構的語音識別模型將每一個輸入時間幀映射為字類別的后驗概率,保留了字級別的信息,且基于cnn結構的語音識別模型側重于局部信息,它由2個卷積層和1個線性層組成。

[0290]

示意性的,將普通話音頻921中所有的時間幀對應的時間幀輸入特征集合922輸入音頻編碼器920中,通過2個卷積層和1個線性層會將每個時間幀對應的時間幀輸入特征映射為字級別的時間幀后驗概率圖,其中,時間幀后驗概率圖的橫坐標用于指示每個時間幀的時間線,縱坐標用于指示字的類別,圖中每個坐標點用于指示在給定時間點出現該字的后驗概率大小,在每個坐標點處的顏越深,概率越大;輸出基于cnn結構的語音識別模型中倒數第二層512維的隱藏層的向量集合,作為普通話音頻921的音頻韻律特征向量923。

[0291]

值得注意的是,基于cnn結構的語音識別模型是在10k小時的wenetspeech數據集上預訓練過的音頻編碼器,下面對基于cnn結構的語音識別模型的預訓練過程進行說明:

[0292]

將10k小時的wenetspeech數據集中的語音輸入基于cnn結構的語音識別模型,獲取預測數據;基于預測數據和預先獲取的真實數據,得到ctc損失;基于ctc損失對基于cnn結構的語音識別模型進行訓練。

[0293]

(3)音頻編碼器920實現為基于conformer結構的語音識別模型。

[0294]

需要說明的是,基于conformer結構的語音識別模型將每一個輸入時間幀映射為字類別的后驗概率,保留了字級別的信息,且基于conformer結構的語音識別模型側重普通話音頻921中包含的整個話語信息,它由2個卷積層、12個conformer模塊以及1個線性層組成。

[0295]

示意性的,將普通話音頻921中所有的時間幀對應的時間幀輸入特征集合922輸入音頻編碼器920中,通過2個卷積層、12個conformer模塊以及1個線性層會將每個時間幀對應的時間幀輸入特征映射為字級別的時間幀后驗概率圖,其中,時間幀后驗概率圖的橫坐標用于指示每個時間幀的時間線,縱坐標用于指示字的類別,圖中每個坐標點用于指示在給定時間點出現該字的后驗概率大小,在每個坐標點處的顏越深,概率越大;輸出基于conformer結構的語音識別模型中倒數第二層512維的隱藏層的向量集合,作為普通話音頻921的音頻韻律特征向量923。

[0296]

值得注意的是,基于conformer結構的語音識別模型是在10k小時的wenetspeech數據集上預訓練過的音頻編碼器,下面對基于conformer結構的語音識別模型的預訓練過程進行說明:

[0297]

將10k小時的wenetspeech數據集中的語音輸入基于conformer結構的語音識別模型,獲取預測數據;基于預測數據和預先獲取的真實數據,得到ctc損失;基于ctc損失對基于conformer結構的語音識別模型進行訓練。

[0298]

s4:音頻韻律特征向量923輸入多模態融合解碼器中。

[0299]

由于幀級別的音頻特征向量比字級別的文本特征向量長很多,故采用交叉注意力結構解決這個問題。

[0300]

其中,多模態融合解碼器中包含第一網絡層931、第一線性層932、第二網絡層933和第二線性層934,第一網絡層931中包含有6個相同的網絡層,每個網絡層包括一個多頭自注意力層和一個前向傳播層,圖9中僅示出了一個網絡層進行說明。

[0301]

將音頻韻律特征向量923輸入堆疊第一網絡層931中6個相同的網絡層中,通過多頭自注意力層和前向傳播層和線性層932,對音頻韻律特征向量923進行維度轉換,獲取與文本韻律特征向量913的維度相同的音頻韻律特征向量935。

[0302]

s5:將與文本韻律特征向量913的維度相同的音頻韻律特征向量935和文本韻律特征向量913輸入第二網絡層933。

[0303]

其中,第二網絡層933中包含有6個相同的網絡層,每個網絡層包括一個多頭交叉注意力層和一個前向傳播層,圖9中僅示出了一個網絡層進行說明。

[0304]

將與文本韻律特征向量913的維度相同的音頻韻律特征向量935和文本韻律特征向量913輸入第二網絡層933中6個相同的網絡層中,在多頭交叉注意力層中對與文本韻律特征向量913維度相同的音頻韻律特征向量935和文本韻律特征向量913進行融合計算,文本韻律特征向量913作為查詢值(query),與文本韻律特征向913量維度相同的音頻韻律特征向量935作為關鍵值(key)和值(value),具體計算公式如下:

[0305]

公式一:q

x

,ko,vo=wqx,wko,w

vo[0306]

公式二:

[0307]

公式一中,用o=[o1,

…

,o

t

]∈r

t

×d和k=[x1,

…

,x

t

]∈rn×d分別表示多頭交叉注意力層的音頻和文本端輸入;q

x

,ko,vo分別代文本端的query輸入、音頻端key輸入、音頻端的value輸入;wq,wk,wv分別代表q

x

,ko,vo的可訓練的矩陣。

[0308]

公式二中,h∈rn×d是多頭交叉注意力層的輸出,即融合韻律特征向量;d表示融合韻律特征向量的維度;softmax為激活函數。

[0309]

值得注意的是,該多頭交叉注意力允許多模態融合解碼器自動學習與文本韻律特征向量913維度相同的音頻韻律特征向量935和文本韻律特征向量913的對齊。

[0310]

s6:在多頭交叉注意力層輸出得到的h∈rn×d,作為融合韻律特征向量,并將融合韻律特征向量輸入第二線性層934,獲取韻律邊界標注序列936:“cc lw cc pw lw cc lw cc cc pph cc lw cc iph”。

[0311]

示意性的,韻律邊界標注序列936中每個序列與中文文本911“我們提出用自動標注器標注韻律”中的每個漢字一一對應,用于指示每個漢字右側的韻律邊界類型。

[0312]

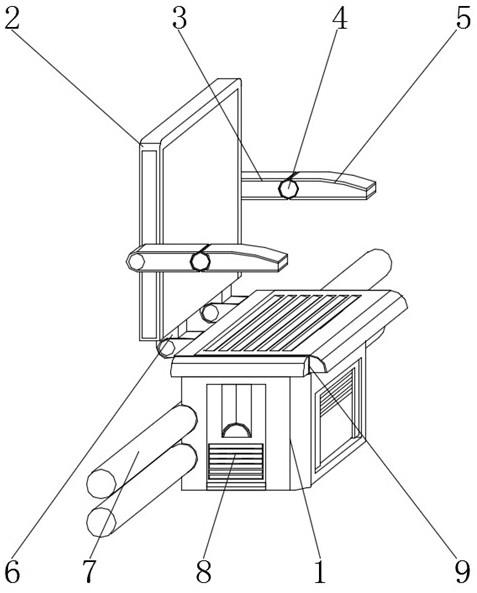

下面,對本技術實施例提供的韻律邊界標注方法的自動指標評測和人工評測結果進行說明,具體介紹如下:

[0313]

首先,介紹評測的數據集。數據集為12.2k條話語(約160小時),其音頻共由28個不同的說話人錄制得到,將其中95%作為訓練集,5%作為驗證集。5.9k條話語(約8.8小時)構成測試集,其音頻由另外9個說話人錄制得到,這9個人與前述28個人沒有重合。

[0314]

1、自動指標評測。

[0315]

請參考圖10,其示出了方法一至方法五的測評指標數據。

[0316]

需要說明的是,其中方法一、方法三、方法四、方法五屬于自動韻律邊界標注模型,且均通過上述訓練集訓練得到;方法二為七個標注員人工標注。圖10中的數據為方法一、方法二、方法三、方法四、方法五在測試集上的韻律邊界標注結果分數。

[0317]

其中,方法一為基于文本輸入的韻律邊界標注方法、方法三為本技術實施例提出的音頻編碼器實現為基于cnn結構的語音識別模型的韻律邊界標注方法、方法四為本技術實施例提出的音頻編碼器實現為基于conformer結構的語音識別模型的韻律邊界標注方法、方法五為本技術實施例提出的音頻編碼器實現為基于conformer結構的語音后驗概率圖提取器的韻律邊界標注方法。

[0318]

其中,條件一代表音頻編碼器是否經過預訓練,條件二代表在自動韻律邊界標注模型訓練過程中音頻編碼器是否凍結參數,

“?”

代表不包括音頻編碼器。

[0319]

其中,“pre.”、“rec.”、“f1”分別代表在測試集上的準確率、召回率和平衡f分數。

[0320]

中文中的韻律邊界分為五個等級,由低到高分別是字(cc),語法詞(lw),韻律詞(pw),韻律短語(pph),語調短語(iph),圖10中展示了后四個韻律邊界的預測結果分數。由圖中結果可見,等級“lw”和“iph”的f1分數基本在0.9以上,即它們的預測較為簡單。則實際,主要對等級“pw”和“pph”的進行分析,得到以下結論:

[0321]

(1)音頻模態信息的加入可使得韻律邊界標注方法更為準確。

[0322]

(2)預訓練能夠提高大模型的性能。基于conformer的方法參數量較大,經過預訓練后有更好的性能,且當模型規模較大時,在訓練中微調會導致過擬合,降低性能。

[0323]

(3)基于conformer結構的方法比基于cnn結構的方法性能更好,不僅歸功于conformer更大的模型規模,還得益于其對上下文語義韻律的建模能力。

[0324]

(4)本技術實施例提出的韻律邊界標注方法在性能上比人工標注要好。

[0325]

此外,請參考圖11,其示出了上述方法二中七個標注員的一致性檢驗系數矩陣1100,可以看到不同的標注員對韻律詞和韻律短語的邊界的理解并不完全一致。如圖11所示,對于韻律詞,不同標注員之間的一致性檢驗系數值顯著低于0.6。這樣會導致,不同批次的,不同標注員的韻律邊界標注由于對于韻律詞和韻律短語的評判標準不一致,而不能直接一起使用。本技術實施例提供的韻律邊界標注方法可以使用統一標準來區分不同粒度的韻律,從而獲得更高的標注一致性。

[0326]

2、人工評測

[0327]

進一步通過兩種人工評測,評價本技術實施例提出的韻律邊界標注方法的性能。

[0328]

(1)對照測試

[0329]

從測試集中隨機選取300條話語,這些話語由方法五(其中,音頻編碼器經過預訓練,其方法對應的模型在訓練時凍結預訓練得到的音頻編碼器參數)產生的預測結果與原數據集中的人工標簽不同。通過3個標注員比較兩種標注哪一種與音頻更為符合。為消除偏差,由方法五自動標注數據和人工標注的數據被打亂。

[0330]

結果表明,有51%(153條)話語,由方法五自動標注的數據比人工標注的數據得到更多的票數。這說明,本技術實施例提出的韻律邊界標注方法準確率與人工標注相當。

[0331]

(2)語音合成系統評測

[0332]

本技術實施例提供的韻律邊界標注方法的其中一個應用場景為語音合成系統提供訓練數據,從而降低標注語音合成系統訓練數據的成本。請參考圖12,服務器獲取到文本

1201和音頻1202,將文本1201和音頻1202輸入到本技術實施例提供的韻律邊界標注方法對應的韻律邊界標注模型1203中,則輸出得到標注了韻律邊界的語音合成系統訓練數據1204。

[0333]

因此,本技術實施例提供的韻律邊界標注方法是否足夠替代人工標注需要在語音合成系統的訓練中探究。

[0334]

分別使用本技術實施例提供的韻律邊界標注方法標注(標注方法一)、人工標注(標注方法二)和無韻律標注(標注方法三)的數據訓練語音合成系統。將相同的文本和韻律輸入這些系統,并對生成的語音進行平均意見得分(mean opinion score,mos)測試。由24個標注員對生成的語音進行打分,根據合成語音的自然程度,最低分為1分,最高分為5分。對于不同韻律標注訓練的語音合成系統所產生的語音,使用95%置信區間的mos測試結果如圖13所示。從結果可以看出,任何種類的韻律邊界標注的數據訓練均可以顯著提升語音合成系統的自然程度。使用本技術實施例提供的韻律邊界標注方法標注的數據訓練的語音合成系統比人工標注韻律的評分更好。這與對照測試的結果是一致的,表明人工標注韻律不一致性使得語音合成系統對韻律邊界產生混淆,難以對其中的韻律建模,相反,本技術實施例提供的韻律邊界標注方法的韻律邊界更利于語音合成系統對韻律的建模。

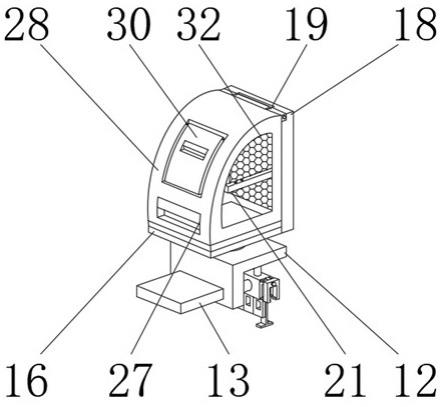

[0335]

請參考圖14,其示出了本技術一個示例性的實施例提供的韻律邊界標注裝置結構框圖,該裝置包括如下模塊:

[0336]

數據獲取模塊1400,用于獲取目標文本和目標音頻,所述目標文本的文本內容與所述目標音頻的音頻內容匹配,所述目標文本為待進行韻律邊界識別的文本;

[0337]

特征提取模塊1410,用于以字符為分析粒度提取所述目標文本的文本韻律特征表示;以及,用于以發聲內容為分析基礎提取所述目標音頻的音頻韻律特征表示;

[0338]

特征融合模塊1420,用于將所述文本韻律特征表示和所述音頻韻律特征表示進行融合,得到融合韻律特征表示;

[0339]

特征分析模塊1430,用于基于所述融合韻律特征表示對所述目標文本進行韻律邊界預測,得到與所述目標文本等長的韻律邊界標注結果,所述韻律邊界標注結果中包括以字符為粒度在所述目標文本上的進行劃分的韻律邊界。

[0340]

在一些可選的實施例中,所述韻律邊界包括字邊界、語法詞邊界、韻律詞邊界、韻律短語邊界、語調短語邊界中的至少一種;

[0341]

所述字邊界是對所述目標文本中的字符進行劃分的邊界;

[0342]

所述語法詞邊界是對所述目標文本中的語法詞進行劃分的邊界;

[0343]

所述韻律詞邊界是對所述目標文本中的韻律詞進行劃分的邊界;

[0344]

所述韻律短語邊界是對所述目標文本中的韻律短語進行劃分的邊界;

[0345]

所述語調短語邊界是對所述目標文本中的語調短語進行劃分的邊界。

[0346]

請參考圖15,在一些可選的實施例中,所述特征分析模塊1430,包括:

[0347]

確定子模塊1431,用于基于所述融合韻律特征表示對所述目標文本進行韻律邊界預測,確定所述目標文本中的字符對應的韻律邊界類型;

[0348]

標注子模塊1432,用于以所述韻律邊界類型對所述目標文本中的字符進行標注,得到與所述目標文本等長的韻律邊界標注結果。

[0349]

在一些可選的實施例中,所述特征提取模塊1410,包括:

[0350]

分割子模塊1411,用于對所述目標文本進行字符分割,得到所述目標文本中的多個字符數據;

[0351]

提取子模塊1412,用于提取多個字符數據分別對應的字向量;

[0352]

第一處理子模塊1413,用于將所述字向量輸入文本編碼器,輸出所述目標文本的文本韻律特征表示,所述文本編碼器是通過文本語料庫預訓練得到的編碼器。

[0353]

所述提取子模塊1412,還用于提取所述目標音頻的頻域特征表示和音高特征表示,所述頻域特征表示和所述音高特征表示用于指示所述目標音頻的發聲內容;在一些可選的實施例中,所述特征提取模塊1410,還包括:

[0354]

拼接子模塊1414,用于對所述頻域特征表示和所述音高特征表示進行拼接,得到目標特征表示;

[0355]

所述第一處理子模塊1413,還用于將目標特征表示輸入音頻編碼器,輸出得到所述目標音頻的音頻韻律特征表示,所述音頻編碼器是通過語音數據集預訓練得到的編碼器。

[0356]

在一些可選的實施例中,所述第一處理子模塊1413,還包括:

[0357]

輸入單元1415,用于將所述目標特征表示輸入所述音頻編碼器,得到第一語音后驗概率圖,所述第一語音后驗概率圖用于指示所述目標音頻的音素級別后驗概率;

[0358]

輸出單元1416,用于基于所述第一語音后驗概率圖,輸出得到所述目標音頻的音頻韻律特征表示。

[0359]

所述輸入單元1415,還用于將所述目標特征表示輸入所述音頻編碼器,得到第二語音后驗概率圖,所述第二語音后驗概率圖用于指示所述目標音頻的字級別后驗概率;所述輸出單元1416,還用于基于所述第二語音后驗概率圖,輸出得到所述目標音頻的音頻韻律特征表示。

[0360]

在一些可選的實施例中,所述目標音頻分割為多個音頻片段分別進行分析,所述目標特征表示中包括目標音頻片段對應的片段特征表示;所述輸入單元1415,還用于將所述片段特征表示輸入所述音頻編碼器,得到所述片段特征表示對應的后驗概率子圖;所述輸出單元1416,還用于將多個音頻片段分別對應的后驗概率子圖進行整合,得到所述第二語音后驗概率圖。

[0361]

在一些可選的實施例中,所述特征融合模塊1420,包括:

[0362]

轉換子模塊1421,用于以所述文本韻律特征表示的維度為目標,對所述音頻韻律特征表示進行維度轉換;所述特征融合模塊1420,還用于將維度轉換后的音頻韻律特征表示與所述文本韻律特征表示進行融合,得到所述融合韻律特征表示。

[0363]

在一些可選的實施例中,所述數據獲取模塊1400,還用于獲取預設短語庫,所述預設短語庫中包括多個預設短語;所述裝置還包括:

[0364]

數據匹配模塊1440,用于將所述目標文本與所述預設短語庫中的預設短語進行匹配,得到參考匹配結果;所述特征分析模塊1430,還包括:

[0365]

預測子模塊1433,用于基于所述融合韻律特征表示對所述目標文本進行韻律邊界預測,得到預測結果;

[0366]

第二處理子模塊1434,用于基于所述預測結果與所述參考匹配結果,得到與所述目標文本等長的所述韻律邊界標注結果。

[0367]

在一些可選的實施例中,所述第二處理子模塊1434,還用于基于所述參考匹配結果對所述預測結果進行調整,得到與所述目標文本等長的所述韻律邊界標注結果。

[0368]

在一些可選的實施例中,所述參考匹配結果中包括韻律邊界參考標注序列,所述預測結果中包括韻律邊界預測標注序列;所述第二處理子模塊1434,還包括:

[0369]

比對單元1435,用于對所述韻律邊界參考標注序列和所述韻律邊界預測標注序列進行比對,得到韻律邊界對比結果,所述韻律邊界對比結果用于指示所述參考匹配結果和所述預測結果之前的差異性;所述第二處理子模塊1434,還用于基于所述韻律邊界對比結果,確定與所述目標文本等長的所述韻律邊界標注結果。

[0370]

在一些可選的實施例中,所述預設短語庫中的預設短語對應有權重,所述韻律邊界參考標注序列中包括第一韻律邊界標識;所述第二處理子模塊1434,還包括:

[0371]

獲取單元1436,用于響應于所述第一韻律邊界標識在所述韻律邊界預測標注序列中不存在,獲取所述目標文本中所述第一韻律邊界標識指示的短語;

[0372]

所述獲取單元1436,還用于將所述短語與所述預設短語庫匹配,獲取與所述短語匹配的權重;

[0373]

更新單元1437,用于響應于與所述短語匹配的權重達到預設權重閾值,更新所述韻律邊界預測標注序列,得到所述韻律邊界標注結果。

[0374]

在一些可選的實施例中,所述數據獲取模塊1400,還用于獲取候選文本和預設語句庫,所述候選文本中包括多個目標語句,所述預設語句庫中包括多個預設語句;所述數據獲取模塊1400,還包括:

[0375]

匹配子模塊1401,用于將多個目標語句分別與所述預設語句庫中的預設語句進行匹配,得到多個語句匹配結果;

[0376]

篩選子模塊1402,用于對多個語句匹配結果進行篩選,得到所述候選文本中與所述預設語句庫中的預設語句匹配失敗的目標語句,作為所述目標文本;以及獲取與所述目標文本相匹配的音頻,作為所述目標音頻。

[0377]

綜上所述,本技術實施例提供的韻律邊界標注裝置,通過將目標文本的文本韻律特征表示和目標音頻的音頻韻律特征表示進行融合,得到融合韻律特征表示,對融合韻律特征表示進行韻律邊界預測,由于音頻韻律特征表示中包含有韻律邊界信息,從而提高了對目標文本進行韻律邊界標注的準確度;且以字符為粒度對目標文本進行分析和預測韻律邊界,提高了韻律邊界標注結果的細粒度,從而進一步提高了對目標文本進行韻律邊界標注的準確度。

[0378]

需要說明的是:上述實施例提供的韻律邊界標注裝置,僅以上述各功能模塊的劃分進行舉例說明,實際應用中,可以根據需要而將上述功能分配由不同的功能模塊完成,即將設備的內部結構劃分成不同的功能模塊,以完成以上描述的全部或者部分功能。另外,上述實施例提供的韻律邊界標注裝置和韻律邊界標注方法實施例屬于同一構思,其具體實現過程詳見方法實施例,這里不再贅述。

[0379]

圖16示出了本技術一個示例性實施例提供的服務器的結構示意圖。該服務器可以是如圖2所示的服務器。具體來講包括以下結構:

[0380]

服務器1600包括中央處理單元(central processing unit,cpu)1601、包括隨機存取存儲器(random access memory,ram)1602和只讀存儲器(read only memory,rom)

1603的系統存儲器1604,以及連接系統存儲器1604和中央處理單元1601的系統總線1605。服務器1600還包括用于存儲操作系統1613、應用程序1614和其他程序模塊1615的大容量存儲設備1606。

[0381]

大容量存儲設備1606通過連接到系統總線1605的大容量存儲控制器(未示出)連接到中央處理單元1601。大容量存儲設備1606及其相關聯的計算機可讀介質為服務器1600提供非易失性存儲。也就是說,大容量存儲設備1606可以包括諸如硬盤或者緊湊型光盤只讀存儲器(compact disc read only memory,cd-rom)驅動器之類的計算機可讀介質(未示出)。

[0382]

不失一般性,計算機可讀介質可以包括計算機存儲介質和通信介質。計算機存儲介質包括以用于存儲諸如計算機可讀指令、數據結構、程序模塊或其他數據等信息的任何方法或技術實現的易失性和非易失性、可移動和不可移動介質。計算機存儲介質包括ram、rom、可擦除可編程只讀存儲器(erasable programmable read only memory,eprom)、帶電可擦可編程只讀存儲器(electrically erasable programmable read only memory,eeprom)、閃存或其他固態存儲技術,cd-rom、數字通用光盤(digital versatile disc,dvd)或其他光學存儲、磁帶盒、磁帶、磁盤存儲或其他磁性存儲設備。當然,本領域技術人員可知計算機存儲介質不局限于上述幾種。上述的系統存儲器1604和大容量存儲設備1606可以統稱為存儲器。

[0383]

根據本技術的各種實施例,服務器1600還可以通過諸如因特網等網絡連接到網絡上的遠程計算機運行。也即服務器1600可以通過連接在系統總線1605上的網絡接口單元1611連接到網絡1612,或者說,也可以使用網絡接口單元1611來連接到其他類型的網絡或遠程計算機系統(未示出)。

[0384]

上述存儲器還包括一個或者一個以上的程序,一個或者一個以上程序存儲于存儲器中,被配置由cpu執行。

[0385]

本技術的實施例還提供了一種計算機設備,該計算機設備可以實現為如圖3所示的終端或者服務器。該計算機設備包括處理器和存儲器,該存儲器中存儲有至少一條指令、至少一段程序、代碼集或指令集,至少一條指令、至少一段程序、代碼集或指令集由處理器加載并執行以實現上述各方法實施例提供的韻律邊界標注方法。

[0386]

本技術的實施例還提供了一種計算機可讀存儲介質,該計算機可讀存儲介質上存儲有至少一條指令、至少一段程序、代碼集或指令集,至少一條指令、至少一段程序、代碼集或指令集由處理器加載并執行,以實現上述各方法實施例提供的韻律邊界標注方法。

[0387]

本技術的實施例還提供了一種計算機程序產品或計算機程序,該計算機程序產品或計算機程序包括計算機指令,該計算機指令存儲在計算機可讀存儲介質中。計算機設備的處理器從計算機可讀存儲介質讀取該計算機指令,處理器執行該計算機指令,使得該計算機設備執行上述各方法實施例提供的韻律邊界標注方法。

[0388]

可選地,該計算機可讀存儲介質可以包括:只讀存儲器(rom,read only memory)、隨機存取記憶體(ram,random access memory)、固態硬盤(ssd,solid state drives)或光盤等。其中,隨機存取記憶體可以包括電阻式隨機存取記憶體(reram,resistance random access memory)和動態隨機存取存儲器(dram,dynamic random access memory)。上述本技術實施例序號僅僅為了描述,不代表實施例的優劣。

[0389]

本領域普通技術人員可以理解實現上述實施例的全部或部分步驟可以通過硬件來完成,也可以通過程序來指令相關的硬件完成,所述的程序可以存儲于一種計算機可讀存儲介質中,上述提到的存儲介質可以是只讀存儲器,磁盤或光盤等。

[0390]

以上所述僅為本技術的可選實施例,并不用以限制本技術,凡在本技術的精神和原則之內,所作的任何修改、等同替換、改進等,均應包含在本技術的保護范圍之內。

技術特征:

1.一種韻律邊界標注方法,其特征在于,所述方法包括:獲取目標文本和目標音頻,所述目標文本的文本內容與所述目標音頻的音頻內容匹配,所述目標文本為待進行韻律邊界識別的文本;以字符為分析粒度提取所述目標文本的文本韻律特征表示;以及,以發聲內容為分析基礎提取所述目標音頻的音頻韻律特征表示;將所述文本韻律特征表示和所述音頻韻律特征表示進行融合,得到融合韻律特征表示;基于所述融合韻律特征表示對所述目標文本進行韻律邊界預測,得到與所述目標文本等長的韻律邊界標注結果,所述韻律邊界標注結果中包括以字符為粒度在所述目標文本上的進行劃分的韻律邊界。2.根據權利要求1所述的方法,其特征在于,所述韻律邊界包括字邊界、語法詞邊界、韻律詞邊界、韻律短語邊界、語調短語邊界中的至少一種;所述字邊界是對所述目標文本中的字符進行劃分的邊界;所述語法詞邊界是對所述目標文本中的語法詞進行劃分的邊界;所述韻律詞邊界是對所述目標文本中的韻律詞進行劃分的邊界;所述韻律短語邊界是對所述目標文本中的韻律短語進行劃分的邊界;所述語調短語邊界是對所述目標文本中的語調短語進行劃分的邊界。3.根據權利要求2所述的方法,其特征在于,所述基于所述融合韻律特征表示對所述目標文本進行韻律邊界預測,得到與所述目標文本等長的韻律邊界標注結果,包括:基于所述融合韻律特征表示對所述目標文本進行韻律邊界預測,確定所述目標文本中的字符對應的韻律邊界類型;以所述韻律邊界類型對所述目標文本中的字符進行標注,得到與所述目標文本等長的韻律邊界標注結果。4.根據權利要求1至3任一所述的方法,其特征在于,所述以字符為分析粒度提取所述目標文本的文本韻律特征表示,包括:對所述目標文本進行字符分割,得到所述目標文本中的多個字符數據;提取多個字符數據分別對應的字向量;將所述字向量輸入文本編碼器,輸出所述目標文本的文本韻律特征表示,所述文本編碼器是通過文本語料庫預訓練得到的編碼器。5.根據權利要求1至3任一所述的方法,其特征在于,所述以發聲內容為分析基礎提取所述目標音頻的音頻韻律特征表示,包括:提取所述目標音頻的頻域特征表示和音高特征表示,所述頻域特征表示和所述音高特征表示用于指示所述目標音頻的發聲內容;對所述頻域特征表示和所述音高特征表示進行拼接,得到目標特征表示;將目標特征表示輸入音頻編碼器,輸出得到所述目標音頻的音頻韻律特征表示,所述音頻編碼器是通過語音數據集預訓練得到的編碼器。6.根據權利要求5所述的方法,其特征在于,所述將目標特征表示輸入音頻編碼器,輸出得到所述目標音頻的音頻韻律特征表示,包括:將所述目標特征表示輸入所述音頻編碼器,得到第一語音后驗概率圖,所述第一語音

后驗概率圖用于指示所述目標音頻的音素級別后驗概率;基于所述第一語音后驗概率圖,輸出得到所述目標音頻的音頻韻律特征表示。7.根據權利要求5所述的方法,其特征在于,所述將目標特征表示輸入音頻編碼器,輸出得到所述目標音頻的音頻韻律特征表示,包括:將所述目標特征表示輸入所述音頻編碼器,得到第二語音后驗概率圖,所述第二語音后驗概率圖用于指示所述目標音頻的字級別后驗概率;基于所述第二語音后驗概率圖,輸出得到所述目標音頻的音頻韻律特征表示。8.根據權利要求7所述的方法,其特征在于,所述目標音頻分割為多個音頻片段分別進行分析,所述目標特征表示中包括目標音頻片段對應的片段特征表示;所述將所述目標特征表示輸入所述音頻編碼器,得到第二語音后驗概率圖,包括:將所述片段特征表示輸入所述音頻編碼器,得到所述片段特征表示對應的后驗概率子圖;將多個音頻片段分別對應的后驗概率子圖進行整合,得到所述第二語音后驗概率圖。9.根據權利要求1至3任一所述的方法,其特征在于,所述將所述文本韻律特征表示和所述音頻韻律特征表示進行融合,得到融合韻律特征表示,包括:以所述文本韻律特征表示的維度為目標,對所述音頻韻律特征表示進行維度轉換;將維度轉換后的音頻韻律特征表示與所述文本韻律特征表示進行融合,得到所述融合韻律特征表示。10.根據權利要求1至3任一所述的方法,其特征在于,所述方法還包括:獲取預設短語庫,所述預設短語庫中包括多個預設短語;將所述目標文本與所述預設短語庫中的預設短語進行匹配,得到參考匹配結果;所述基于所述融合韻律特征表示對所述目標文本進行韻律邊界預測,得到與所述目標文本等長的韻律邊界標注結果,包括:基于所述融合韻律特征表示對所述目標文本進行韻律邊界預測,得到預測結果;基于所述預測結果與所述參考匹配結果,得到與所述目標文本等長的所述韻律邊界標注結果。11.根據權利要求10所述的方法,其特征在于,所述基于所述預測結果與所述參考匹配結果,得到與所述目標文本等長的所述韻律邊界標注結果,包括:基于所述參考匹配結果對所述預測結果進行調整,得到與所述目標文本等長的所述韻律邊界標注結果。12.根據權利要求11所述的方法,其特征在于,所述參考匹配結果中包括韻律邊界參考標注序列,所述預測結果中包括韻律邊界預測標注序列;所述基于所述參考匹配結果對所述預測結果進行調整,得到與所述目標文本等長的所述韻律邊界標注結果,包括:對所述韻律邊界參考標注序列和所述韻律邊界預測標注序列進行比對,得到韻律邊界對比結果,所述韻律邊界對比結果用于指示所述參考匹配結果和所述預測結果之前的差異性;基于所述韻律邊界對比結果,確定與所述目標文本等長的所述韻律邊界標注結果。13.根據權利要求12所述的方法,其特征在于,所述預設短語庫中的預設短語對應有權

重,所述韻律邊界參考標注序列中包括第一韻律邊界標識;所述基于所述韻律邊界對比結果,得到與所述目標文本等長的所述韻律邊界標注結果,包括:響應于所述第一韻律邊界標識在所述韻律邊界預測標注序列中不存在,獲取所述目標文本中所述第一韻律邊界標識指示的短語;將所述短語與所述預設短語庫匹配,獲取與所述短語匹配的權重;響應于與所述短語匹配的權重達到預設權重閾值,更新所述韻律邊界預測標注序列,得到所述韻律邊界標注結果。14.根據權利要求1至3任一所述的方法,其特征在于,所述獲取目標文本和目標音頻,包括:獲取候選文本和預設語句庫,所述候選文本中包括多個目標語句,所述預設語句庫中包括多個預設語句;將多個目標語句分別與所述預設語句庫中的預設語句進行匹配,得到多個語句匹配結果;對多個語句匹配結果進行篩選,得到所述候選文本中與所述預設語句庫中的預設語句匹配失敗的目標語句,作為所述目標文本;以及獲取與所述目標文本相匹配的音頻,作為所述目標音頻。15.一種韻律邊界標注裝置,其特征在于,所述裝置包括:數據獲取模塊,用于獲取目標文本和目標音頻,所述目標文本的文本內容與所述目標音頻的音頻內容匹配,所述目標文本為待進行韻律邊界識別的文本;特征提取模塊,用于以字符為分析粒度提取所述目標文本的文本韻律特征表示;以及,用于以發聲內容為分析基礎提取所述目標音頻的音頻韻律特征表示;特征融合模塊,用于將所述文本韻律特征表示和所述音頻韻律特征表示進行融合,得到融合韻律特征表示;特征分析模塊,用于基于所述融合韻律特征表示對所述目標文本進行韻律邊界預測,得到與所述目標文本等長的韻律邊界標注結果,所述韻律邊界標注結果中包括以字符為粒度在所述目標文本上的進行劃分的韻律邊界。16.一種計算機設備,其特征在于,所述計算機設備包括處理器和存儲器,所述存儲器中存儲有至少一段程序,所述至少一段程序由所述處理器加載并執行以實現如權利要求1至14任一所述的韻律邊界標注方法。17.一種計算機可讀存儲介質,其特征在于,所述存儲介質中存儲有至少一段程序,所述至少一段程序由處理器加載并執行以實現如權利要求1至14任一所述的韻律邊界標注方法。18.一種計算機程序產品,其特征在于,包括計算機指令,所述計算機指令被處理器執行時實現如權利要求1至14任一所述的韻律邊界標注方法。

技術總結

本申請公開了一種韻律邊界標注方法、裝置、設備、介質及程序產品,涉及機器學習領域。該方法包括:獲取目標文本和目標音頻,以字符為分析粒度提取目標文本的文本韻律特征表示;以及,以發聲內容為分析基礎提取目標音頻的音頻韻律特征表示;將文本韻律特征表示和音頻韻律特征表示進行融合,得到融合韻律特征表示;基于所述融合韻律特征表示對目標文本進行韻律邊界預測,得到與目標文本等長的韻律邊界標注結果。通過對融合韻律特征表示進行韻律邊界預測,提高了對目標文本進行韻律邊界標注的準確度;且以字符為粒度對目標文本進行分析和預測韻律邊界,提高了韻律邊界標注結果的細粒度,從而進一步提高了對目標文本進行韻律邊界標注的準確度。標注的準確度。標注的準確度。