基于Uet網(wǎng)絡(luò)與分水嶺算法的電鏡紅細(xì)胞分割與定位方法

基于unet網(wǎng)絡(luò)與分水嶺算法的電鏡紅細(xì)胞分割與定位方法

技術(shù)領(lǐng)域

1.本發(fā)明涉及電鏡細(xì)胞診斷技術(shù)領(lǐng)域,尤其涉及一種基于unet網(wǎng)絡(luò)與分水嶺算法的電鏡紅細(xì)胞分割與定位方法。

背景技術(shù):

2.電鏡圖像作為檢測(cè)人體疾病的重要手段,近年來越來越被廣泛應(yīng)用。傳統(tǒng)的電鏡圖像病理診斷主要通過病理醫(yī)師對(duì)電鏡圖像中細(xì)胞的形態(tài)、大小進(jìn)行判定和計(jì)數(shù),這無疑大大降低了醫(yī)生的工作效率,并且診斷結(jié)果具備較強(qiáng)的主觀性。因此,利用計(jì)算機(jī)技術(shù)輔助醫(yī)生進(jìn)行電鏡圖像分析具有重要意義。

3.另一方面,隨著深度學(xué)習(xí)和計(jì)算機(jī)硬件的發(fā)展,越來越多的深度學(xué)習(xí)方法被用于醫(yī)學(xué)圖像處理中。有研究者運(yùn)用weighted res-unet,通過加權(quán)背景和前景不同的損失計(jì)算,以及基于殘差網(wǎng)絡(luò)的unet模型,很好地解決了眼底血管分割問題。有研究者用unet模型進(jìn)行t細(xì)胞的斑點(diǎn)檢測(cè),并與基于區(qū)域生長(zhǎng)的傳統(tǒng)分割方法相比,分割精度有較大提升,驗(yàn)證了深度學(xué)習(xí)模型在醫(yī)學(xué)影像領(lǐng)域的可行性。近年來,深度學(xué)習(xí)模型在醫(yī)學(xué)影響的應(yīng)用方興未艾,有研究者提出基于多模態(tài)特征融合圖像分割網(wǎng)絡(luò)進(jìn)行腦瘤圖像的分割,驗(yàn)證了級(jí)間融合和層間跳躍連接的加入對(duì)多模態(tài)醫(yī)學(xué)圖像的分割效果有提升作用;提出基于注意力與金字塔融合的醫(yī)學(xué)圖像分割網(wǎng)絡(luò),有效地改善了分割圖像邊緣模糊問題;提出融合邊緣增強(qiáng)的注意力機(jī)制模塊,捕獲具有位置感知的跨通道信息及更加明確的邊緣輪廓信息,從而提高了分割的準(zhǔn)確性。以上工作都給本文用深度學(xué)習(xí)模型解決醫(yī)療數(shù)據(jù)中的問題提供了實(shí)際參考意義。

4.而在異常紅細(xì)胞的分割計(jì)數(shù)研究中,現(xiàn)存文獻(xiàn)大多以血紅涂片數(shù)據(jù)集為研究對(duì)象。但是上述工作基于血紅圖片細(xì)胞數(shù)據(jù)集對(duì)比度高、數(shù)據(jù)量豐富的特點(diǎn),而對(duì)于電鏡圖像數(shù)據(jù)圖像對(duì)比度低、數(shù)據(jù)量稀少的特點(diǎn),如何準(zhǔn)確、快速分割定位血細(xì)胞成為關(guān)鍵難點(diǎn)。

技術(shù)實(shí)現(xiàn)要素:

5.本發(fā)明提供一種基于unet網(wǎng)絡(luò)與分水嶺算法的電鏡紅細(xì)胞分割與定位方法,解決的技術(shù)問題在于:如何準(zhǔn)確、快速分割定位血細(xì)胞。

6.為解決以上技術(shù)問題,本發(fā)明提供一種基于unet網(wǎng)絡(luò)與分水嶺算法的電鏡紅細(xì)胞分割與定位方法,包括步驟:

7.s1、構(gòu)建基于unet網(wǎng)絡(luò)的多注意力分割模型對(duì)電鏡紅細(xì)胞進(jìn)行細(xì)胞前后景的分割;

8.s2、基于分水嶺算法對(duì)分割好的圖形進(jìn)行細(xì)胞的定位與分割。

9.進(jìn)一步地,在所述步驟s1中,所述多注意力分割模型包括仿照unet網(wǎng)絡(luò)設(shè)計(jì)的編碼器網(wǎng)絡(luò)、解碼器網(wǎng)絡(luò),所述編碼器網(wǎng)絡(luò)包括第一層至第五層的第一殘差塊、第二殘差塊、第三殘差塊、第一自注意力機(jī)制塊、第二自注意力機(jī)制塊,所述解碼器網(wǎng)絡(luò)包括第四層至第一層的第一深度可分離卷積塊、第二深度可分離卷積塊、第一解碼器塊和第二解碼器塊,所

述多注意力分割模型還包括設(shè)置在對(duì)應(yīng)層的跳躍連接階段的4個(gè)特征選擇模塊;

10.所述第一自注意力機(jī)制塊、第二自注意力機(jī)制塊用卷積操作提取圖像的低維特征,同時(shí)仿照transformer對(duì)圖像高維特征進(jìn)行遠(yuǎn)距離建模;

11.所述第一深度可分離卷積塊、所述第二深度可分離卷積塊在整個(gè)網(wǎng)絡(luò)中保持相同的大小和分辨率的情況下,借助深度可分離卷積和point wise卷積分離混合空間維度和通道維度;

12.所述特征選擇模塊進(jìn)行特征融合時(shí)的特征選取。

13.進(jìn)一步地,所述特征選擇模塊包括通道注意力機(jī)制模塊和空間注意力機(jī)制模塊;

14.在所述通道注意力機(jī)制模塊中,圖像在經(jīng)過cnn特征提取后,特征層首先通過自適應(yīng)平均池化層得到大小為c*1*1的特征圖,其中c為特征通道數(shù),接著通過卷積核大小為k的1維卷積核進(jìn)行卷積加權(quán),實(shí)現(xiàn)不同通道之間的信息交互,再經(jīng)過sigmoid函數(shù)得到每個(gè)特征通道的權(quán)重,對(duì)整體特征圖進(jìn)行加權(quán)得到通道加權(quán)圖,最后將通道加權(quán)后的特征圖輸入所述空間注意力機(jī)制模塊;

15.在所述空間注意力機(jī)制模塊中,對(duì)輸入的特征圖的特征維度分別進(jìn)行最大池化和平均池化操作,將特征維度轉(zhuǎn)換成1*h*w,h、w分別為原始圖像的高和寬,將這兩個(gè)特征圖進(jìn)行拼接后,送入卷積核大小可調(diào)的卷積核中進(jìn)行信息交互與特征重構(gòu),最終得到空間特征權(quán)重,將其與經(jīng)通道注意力處理過的特征圖加權(quán)后得到最終的特征圖。

16.進(jìn)一步地,在所述第一自注意力機(jī)制塊或所述第二自注意力機(jī)制塊中,首先對(duì)特征圖進(jìn)行特征編碼,編碼后的每個(gè)詞向量大小為p*p,個(gè)數(shù)為h*w/(p*p),隨后采用深度可分離卷積操作編碼位置信息。

17.進(jìn)一步地,在所述步驟s1中,在訓(xùn)練所述多注意力分割模型的過程中采用的損失函數(shù)為:

[0018][0019]

其中,表示bce損失,表示dice損失,且有:

[0020][0021][0022]

其中,p和q分別代表預(yù)測(cè)的像素值和它的實(shí)際像素值,w1、w2分別表示前景與背景計(jì)算損失時(shí)的權(quán)重,k表示第k個(gè)像素點(diǎn),n為像素點(diǎn)總數(shù),x、y分別表示預(yù)測(cè)元素與真實(shí)元素,|x∩y|表示預(yù)測(cè)元素與真實(shí)元素的交集,|x|,|y|表示各自的元素個(gè)數(shù)。

[0023]

優(yōu)選的,w1:w2=2:1。

[0024]

優(yōu)選的,訓(xùn)練及測(cè)試所述多注意力分割模型所采用的數(shù)據(jù)集包括48張密集細(xì)胞圖和42張高倍放大圖以及對(duì)這些圖像進(jìn)行數(shù)據(jù)擴(kuò)增后的圖像,而對(duì)應(yīng)的標(biāo)簽圖是利用圖像工具對(duì)原圖進(jìn)行目標(biāo)區(qū)域填充再進(jìn)行二值化去噪處理得到的二值化圖像。

[0025]

進(jìn)一步地,所述步驟s2具體包括步驟:

[0026]

s21、通過深度學(xué)習(xí)模型對(duì)步驟s1得到的電鏡圖像前后景進(jìn)行粗分割,分割結(jié)果為0或者1的二值化圖像,進(jìn)行灰度化后顯示為黑白圖像,其中黑為與電鏡細(xì)胞無關(guān)的背景

區(qū)域或非細(xì)胞物體,白為目標(biāo)細(xì)胞區(qū)域;

[0027]

s22、將原始粗分割圖像進(jìn)行膨脹后得到的背景區(qū)域作為圖像的背景,將篩選合適距離值進(jìn)行距離變換后得到的前景區(qū)域作為圖像的前景;

[0028]

s23、將圖像前景和背景之間的區(qū)域標(biāo)記為未知區(qū)域,采用分水嶺算法對(duì)未知區(qū)域的前景、后景進(jìn)行劃分;

[0029]

s24、將劃分好的圖像進(jìn)行連通區(qū)域判定,分割出單獨(dú)的細(xì)胞區(qū)域并且得到位置信息。

[0030]

本發(fā)明提供的一種基于unet網(wǎng)絡(luò)與分水嶺算法的電鏡紅細(xì)胞分割與定位方法,其首先采用數(shù)據(jù)增強(qiáng)等方法擴(kuò)充數(shù)據(jù)集豐富度,接著采用設(shè)計(jì)的多注意力分割模型aca-unet進(jìn)行細(xì)胞前后景的分割。最后將分割好的圖形進(jìn)行距離變換、分水嶺修正后,尋單個(gè)細(xì)胞區(qū)域,完成細(xì)胞的定位與分割。本方法第一次將計(jì)算機(jī)輔助算法應(yīng)用到電鏡數(shù)據(jù)集上,實(shí)驗(yàn)中,密集細(xì)胞分割的dice系數(shù)達(dá)到88.94%,高倍放大細(xì)胞分割的dice系數(shù)達(dá)到93.10%。

附圖說明

[0031]

圖1是本發(fā)明實(shí)施例提供的兩類電鏡圖像數(shù)據(jù)集示例圖;

[0032]

圖2是本發(fā)明實(shí)施例提供的圖像預(yù)處理效果圖;

[0033]

圖3是本發(fā)明實(shí)施例提供的aca-unet網(wǎng)絡(luò)結(jié)構(gòu)圖;

[0034]

圖4是本發(fā)明實(shí)施例提供的unet骨架網(wǎng)絡(luò)圖;

[0035]

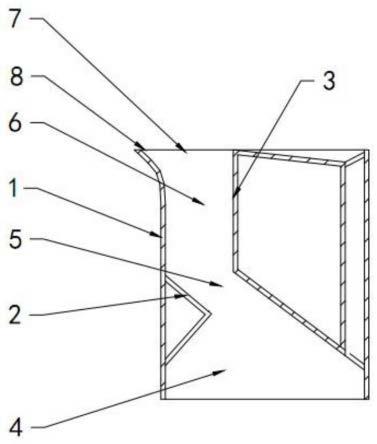

圖5是本發(fā)明實(shí)施例提供的特征選擇模塊的結(jié)構(gòu)圖;

[0036]

圖6是本發(fā)明實(shí)施例提供的自注意力機(jī)制塊的結(jié)構(gòu)圖;

[0037]

圖7是本發(fā)明實(shí)施例提供的深度可分離卷積模塊的結(jié)構(gòu)圖;

[0038]

圖8是本發(fā)明實(shí)施例提供的基于分水嶺算法進(jìn)行細(xì)胞分割計(jì)數(shù)的步驟圖;

[0039]

圖9是本發(fā)明實(shí)施例提供的密集細(xì)胞分割計(jì)數(shù)示例圖;

[0040]

圖10是本發(fā)明實(shí)施例提供的高倍放大細(xì)胞分割計(jì)數(shù)圖;

[0041]

圖11是本發(fā)明實(shí)施例提供的不同模型測(cè)試集效果的比對(duì)圖。

具體實(shí)施方式

[0042]

下面結(jié)合附圖具體闡明本發(fā)明的實(shí)施方式,實(shí)施例的給出僅僅是為了說明目的,并不能理解為對(duì)本發(fā)明的限定,包括附圖僅供參考和說明使用,不構(gòu)成對(duì)本發(fā)明專利保護(hù)范圍的限制,因?yàn)樵诓幻撾x本發(fā)明精神和范圍基礎(chǔ)上,可以對(duì)本發(fā)明進(jìn)行許多改變。

[0043]

針對(duì)電鏡紅細(xì)胞圖像對(duì)比度低、數(shù)據(jù)量少的特點(diǎn),本發(fā)明實(shí)施例提供一種基于unet網(wǎng)絡(luò)與分水嶺算法的電鏡紅細(xì)胞分割與定位方法,包括步驟:

[0044]

s1、構(gòu)建基于unet網(wǎng)絡(luò)的多注意力分割模型(本例稱之為aca-unet網(wǎng)絡(luò))對(duì)電鏡紅細(xì)胞進(jìn)行細(xì)胞前后景的分割;

[0045]

s2、基于分水嶺算法對(duì)分割好的圖形進(jìn)行細(xì)胞的定位與分割。

[0046]

本文所用數(shù)據(jù)集來源于重慶醫(yī)科大學(xué)附屬第一醫(yī)院,與傳統(tǒng)的血液圖片不同,電鏡圖像對(duì)比度低,分辨率高,圖像呈現(xiàn)為灰度,前景與背景雜糅嚴(yán)重。因此不適用于傳統(tǒng)的分割方法如大津閾值(otsu)等進(jìn)行分割。本文設(shè)計(jì)適用的深度學(xué)習(xí)模型進(jìn)行細(xì)胞的定位分割與計(jì)數(shù)。在本文中,所用的電鏡圖像數(shù)據(jù)集可以分為密集細(xì)胞數(shù)據(jù)集和高倍放大數(shù)據(jù)集,

其中部分圖像數(shù)據(jù)示例如圖1所示,其中圖1的(a)為高倍放大圖,(b)為密集細(xì)胞圖。

[0047]

對(duì)于圖2(a)示例的原圖,還需要生成對(duì)應(yīng)的標(biāo)簽圖。為了保證盡可能的保留更多的邊界信息,本文并未采用傳統(tǒng)的錨點(diǎn)劃定選區(qū)的方式,而是利用photoshop等圖像工具進(jìn)行目標(biāo)區(qū)域填充(興趣區(qū)域即紅細(xì)胞區(qū)域填充為白),但是最終填充后的圖像并非是單純的二值化圖像,如圖2(b),其中有著許多明暗度不明顯的噪點(diǎn),所以還需要對(duì)人工填充完畢的圖像進(jìn)行二值化去噪處理,得到的標(biāo)簽圖如圖2(c)所示。

[0048]

由于電鏡圖像的特殊性,合作機(jī)構(gòu)所提供的數(shù)據(jù)有限,僅包括48張密集細(xì)胞圖(dense image)和42張高倍放大圖(high image),因此本文用翻轉(zhuǎn)、旋轉(zhuǎn)等空間變換擴(kuò)大數(shù)據(jù)集的語義豐富性,同時(shí)為了保證電鏡圖像原圖的相關(guān)信息,本文避免使用彩變換等相關(guān)操作。在進(jìn)行數(shù)據(jù)擴(kuò)增的操作后,本文選取其中的20%的數(shù)據(jù)作為測(cè)試集,其他為訓(xùn)練集,進(jìn)行電鏡圖像的數(shù)據(jù)特征學(xué)習(xí)與模型驗(yàn)證。

[0049]

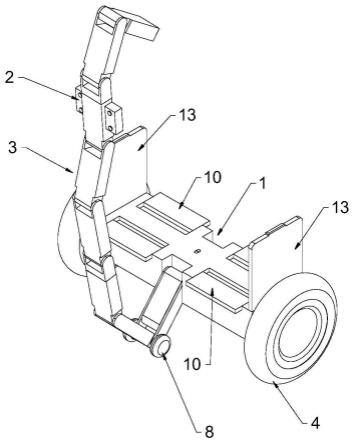

本文所提出的aca-unet網(wǎng)絡(luò)是基于unet網(wǎng)絡(luò)的編碼器與解碼器結(jié)構(gòu),主要包擴(kuò)4個(gè)部分:(1)unet基本骨架;(2)特征選取模塊;(3)高層語義特征的自注意力機(jī)制模塊(包括自注意力機(jī)制塊1、自注意力機(jī)制塊2);(4)深度可分離卷積模塊(包括深度可分離卷積塊1、深度可分離卷積塊2)。該模型總體簡(jiǎn)易結(jié)構(gòu)如圖3所示。具體而言,多注意力分割模型包括仿照unet網(wǎng)絡(luò)設(shè)計(jì)的編碼器網(wǎng)絡(luò)、解碼器網(wǎng)絡(luò),編碼器網(wǎng)絡(luò)包括第一層至第五層的第一殘差塊(即殘差塊1)、第二殘差塊(即殘差塊2)、第三殘差塊(即殘差塊3)、第一自注意力機(jī)制塊(即自注意力機(jī)制塊1)、第二自注意力機(jī)制塊(即自注意力機(jī)制塊2),解碼器網(wǎng)絡(luò)包括第四層至第一層的第一深度可分離卷積塊(即深度可分離卷積塊1)、第二深度可分離卷積塊(即深度可分離卷積塊2)、第一解碼器塊(即解碼器塊1)和第二解碼器塊(即解碼器塊2),多注意力分割模型還包括設(shè)置在對(duì)應(yīng)層的跳躍連接階段的4個(gè)特征選擇模塊(用fs代指)。

[0050]

其中,unet基本骨架為aca-unet網(wǎng)絡(luò)的骨干架構(gòu),核心為提取圖像特征的下采樣模塊和恢復(fù)圖像分辨率的上采樣模塊。特征選擇模塊為充分融合圖像通道和空間特征信息而設(shè)計(jì)的模塊。自注意力機(jī)制模塊為圖像在高層語義信息中進(jìn)行全局建模。深度可分離卷積模塊可以在降低模型參數(shù)量的情況下,適當(dāng)提升模型的性能。

[0051]

具體的,unet基本骨架作為醫(yī)學(xué)圖像分割領(lǐng)域中的經(jīng)典網(wǎng)絡(luò),近年來也衍生了許多變種。但是其核心思想始終未變,其結(jié)構(gòu)主要由捕獲全局信息的下采樣路徑(編碼器網(wǎng)絡(luò))和逐步恢復(fù)像素尺度的上采樣路徑(解碼器網(wǎng)絡(luò))組成,近些年來其在眾多分割任務(wù)中表現(xiàn)良好。在本文中,本文遵循unet網(wǎng)絡(luò)的基本架構(gòu),在此基礎(chǔ)上做出一些調(diào)整。并且,由于本文分割細(xì)胞圖像任務(wù)的特殊性和專一性,本文調(diào)整網(wǎng)絡(luò)的相關(guān)特征通道數(shù)以減少模型開銷。本文采用的unet網(wǎng)絡(luò)骨架結(jié)構(gòu)如圖4所示。結(jié)合圖3和圖4可以看到,本文aca-unet網(wǎng)絡(luò)的輸入圖像為3

×

512

×

512的圖像,經(jīng)殘差塊1進(jìn)行下采樣后,圖像的通道數(shù)變?yōu)?2,再經(jīng)殘差塊2進(jìn)行下采樣后,圖像的通道數(shù)變?yōu)?4,高和寬分別變?yōu)樵瓐D像的1/2,再經(jīng)殘差塊3進(jìn)行下采樣后,圖像的通道數(shù)變?yōu)?28,高和寬分別變?yōu)樵瓐D像的1/4,再經(jīng)自注意力機(jī)制塊1進(jìn)行下采樣后,圖像的通道數(shù)變?yōu)?56,高和寬分別變?yōu)樵瓐D像的1/8,再經(jīng)自注意力機(jī)制塊2進(jìn)行下采樣后,圖像的通道數(shù)變?yōu)?12,高和寬分別變?yōu)樵瓐D像的1/16。殘差塊的具體結(jié)構(gòu)如圖3右半部分所示。

[0052]

為解決unet模塊下采樣時(shí)信息丟失問題,本文在unet跳躍連接階段設(shè)計(jì)特征選擇模塊進(jìn)行特征融合時(shí)的特征選取。特征選擇模塊如圖5所示,包括通道注意力機(jī)制模塊和空

間注意力機(jī)制模塊。首先,圖像在經(jīng)過cnn特征提取后,特征層首先通過自適應(yīng)平均池化層得到大小為c*1*1的特征圖,其中c為特征通道數(shù),接著通過卷積核大小為k的1維卷積核進(jìn)行卷積加權(quán),實(shí)現(xiàn)不同通道之間的信息交互。再經(jīng)過sigmoid函數(shù)得到每個(gè)特征通道的權(quán)重,對(duì)整體特征圖進(jìn)行加權(quán)得到通道加權(quán)圖。然后,將通道加權(quán)后的特征圖輸入空間注意力機(jī)制模塊,首先對(duì)特征圖的特征維度進(jìn)行最大池化和平均池化(取均值)操作,將特征維度轉(zhuǎn)換成1*h*w(h、w分別為原始圖像的高和寬),將這兩個(gè)特征圖進(jìn)行拼接后,送入卷積核大小可調(diào)的卷積核中進(jìn)行信息交互與特征重構(gòu),最終得到空間特征權(quán)重。將其與經(jīng)通道注意力處理過的特征圖加權(quán)后得到最終的特征圖。

[0053]

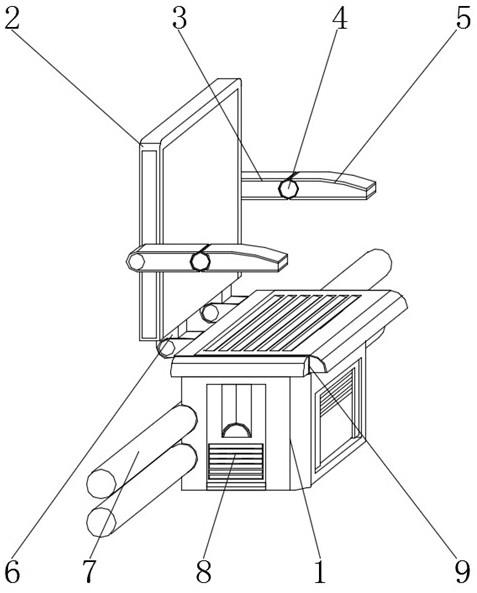

為了建模特征圖的長(zhǎng)距離語義依賴,更好地提取圖像的語義特征,本文用卷積操作提取圖像的低維特征,同時(shí)仿照transformer構(gòu)建自注意力機(jī)制模塊對(duì)圖像高維特征進(jìn)行遠(yuǎn)距離建模。該模塊整體如圖6所示。特征圖首先進(jìn)行特征編碼,編碼后的每個(gè)詞向量大小為p*p,個(gè)數(shù)為h*w/p*p,在位置信息編碼方式,本文采用深度可分離卷積操作(dw)編碼位置信息,該模塊能夠有效的對(duì)位置進(jìn)行編碼,且參數(shù)量較少。在具體實(shí)現(xiàn)上,首先,圖像經(jīng)過unet網(wǎng)絡(luò)相應(yīng)的卷積塊進(jìn)行特征提取后形成特征圖,將該特征圖送入卷積核大小為k,步距為s的卷積模塊進(jìn)行卷積和詞嵌入操作。接著,將詞嵌入化的特征圖進(jìn)行維度變換,即將大小為c*h*w的特征圖變換為p*c的詞塊,其中p為h與w的乘積。隨后,將詞向量化后的詞塊歸一化后,為充分探究每個(gè)詞塊之間的相互關(guān)系,采用多頭注意力機(jī)制進(jìn)行長(zhǎng)距離建模。核心思想為對(duì)每個(gè)詞塊形成q、k、v矩陣,用每個(gè)詞塊的q對(duì)其余詞塊的k進(jìn)行相似性計(jì)算,隨后與其對(duì)應(yīng)的v值相乘得到最終結(jié)果。接下來依次通過殘差連接和歸一化,全連接層學(xué)習(xí)潛在特征,深度可分離卷積進(jìn)行卷積位置編碼,再次通過全連接層學(xué)習(xí)隱藏特征,對(duì)詞塊進(jìn)行維度還原為c*h*w的圖像特征塊,得到最終結(jié)果。

[0054]

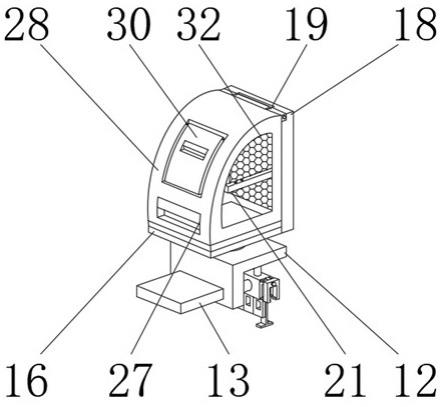

為緩解分割模型參數(shù)過大不易部署的問題,本文采用了深度可分離卷積模塊對(duì)特征圖進(jìn)行建模,該模塊可以在整個(gè)網(wǎng)絡(luò)中保持相同的大小和分辨率的情況下,借助depthwise卷積(dw卷積)和pointwise卷積分離混合空間維度和通道維度,但是該模塊在減少模型參數(shù)量的同時(shí),也會(huì)降低模型的推理速度和訓(xùn)練速度,因此本文僅在模型上采樣時(shí)采用dw卷積。深度可分離卷積模塊的具體結(jié)構(gòu)如圖7所示。具體實(shí)現(xiàn)為,采用積核大小為k,步距為s的卷積模塊對(duì)輸入的圖像特征進(jìn)行卷積操作,卷積后圖像特征大小變?yōu)樵瓉淼?/s。將卷積操作后的圖經(jīng)過depthwise卷積進(jìn)行卷積操作,其中若輸入的圖像特征通道數(shù)為c,則進(jìn)行depthwise卷積的卷積核個(gè)數(shù)為c,且每個(gè)卷積核分別與輸入特征的一個(gè)通道進(jìn)行卷積運(yùn)算,學(xué)習(xí)相關(guān)特征。在經(jīng)過gelu激活函數(shù)和批歸一化操作后,圖像特征再由pointwise卷積進(jìn)行卷積操作,其中,pointwise卷積為核大小為1的卷積核,其個(gè)數(shù)決定輸出圖像的特征通道數(shù)。最后,再次經(jīng)過gelu激活函數(shù)和批歸一化操作后得到最終圖像特征。

[0055]

本文采用混合損失函數(shù),用dice loss損失和bce loss的數(shù)值總和來衡量預(yù)測(cè)特征圖與真實(shí)特征圖的差距,整體損失函數(shù)公式如公式(3)所示。本文將bce loss和dice loss的和作為總損失。其中dice loss如公式(1)所示,p和q分別代表預(yù)測(cè)的像素值和它的實(shí)際像素值。w1、w2分別表示前景與背景計(jì)算損失時(shí)的權(quán)重。本文為二分類前后景問題,為更好地區(qū)分單個(gè)細(xì)胞,本文提高模型分割背景的權(quán)重,以使本文的模型更多地關(guān)注圖像背景和每個(gè)細(xì)胞間的邊界。bce loss如公式(2)所示,其中|x∩y|表示預(yù)測(cè)元素與真實(shí)元素的交集,|x|,|y|表示各自的元素個(gè)數(shù)。

size為4,訓(xùn)練輪數(shù)設(shè)置為40,采用adam優(yōu)化器進(jìn)行梯度更新,在完成所有輪數(shù)訓(xùn)練后本文得到最終的訓(xùn)練模型。本文將所提出模型的性能同最近廣泛流行的分割模型進(jìn)行比較,密集細(xì)胞數(shù)據(jù)集即放大細(xì)胞數(shù)據(jù)集的比較結(jié)果分別如表1和表2所示。其中,本發(fā)明提出的模型在高倍放大訓(xùn)練數(shù)據(jù)集上表現(xiàn)較差,推測(cè)是因?yàn)楦弑斗糯髷?shù)據(jù)集單個(gè)細(xì)胞區(qū)域過大,且單個(gè)細(xì)胞間距離過小,自注意力機(jī)制不能很好通過編碼詞塊之間的聯(lián)系構(gòu)建全局上下文信息。故本發(fā)明用dw卷積提取圖像特征,對(duì)比結(jié)果如表2所示。

[0075]

表1密集細(xì)胞訓(xùn)練效果對(duì)比圖

[0076][0077][0078]

表2放大細(xì)胞訓(xùn)練效果對(duì)比圖

[0079][0080]

在圖11,本文比較了不同模型測(cè)試集效果的比對(duì),可以看出本文的模型在過分割、欠分割以及細(xì)節(jié)處理上有著較強(qiáng)的表現(xiàn)力,也更接近真實(shí)標(biāo)簽。

[0081]

(2)分水嶺分割后處理及計(jì)數(shù)

[0082]

在衡量分割及計(jì)數(shù)精度上,本文用tp、tn、fp、fn衡量算法的性能。其中tp表示把細(xì)胞分割正確的個(gè)數(shù)(即將單個(gè)細(xì)胞分割成單個(gè)細(xì)胞),tn表示將細(xì)胞分割錯(cuò)誤的個(gè)數(shù)(即將單個(gè)細(xì)胞分割成多個(gè)細(xì)胞或不分割的個(gè)數(shù)),ft表示將不是細(xì)胞的分割正確的個(gè)數(shù),fn表示將不是細(xì)胞的物體分割成細(xì)胞的個(gè)數(shù)。因?yàn)椴皇羌?xì)胞的物體主要在初分割時(shí)過濾,因此fn與ft數(shù)值由本文提出的模型性能決定。本文用分割正確的細(xì)胞數(shù)占全部細(xì)胞的比例(acc)衡量整體分割效果。本文隨機(jī)選擇若干圖像進(jìn)行測(cè)試,部分測(cè)試圖像如圖11所示,測(cè)試指標(biāo)如表3所示(編號(hào)1~3對(duì)應(yīng)圖11中的密集細(xì)胞圖1~3,編號(hào)4、5分別對(duì)應(yīng)圖11中的高倍放大圖1、2)。

[0083]

表3

[0084][0085]

從表3及圖11可以看出,密集細(xì)胞分割效果完美,高倍放大細(xì)胞圖像因?yàn)榧?xì)胞重疊程度較高,分割效果較差,但整體分割效果都較好,符合本文的分割要求。

[0086]

(3)注意力機(jī)制的消融實(shí)驗(yàn)

[0087]

本文對(duì)所提出的模型進(jìn)行消融實(shí)驗(yàn),以驗(yàn)證模型的有效性。整體模型如圖3所示,本文依次去除自注意力機(jī)制模塊(aca-unet_mini1)和特征選擇模塊(aca-unet_mini2),觀察模型性能的變換,整體效果如表4所示。

[0088]

表4注意力機(jī)制的消融實(shí)驗(yàn)

[0089][0090]

可以看到,本發(fā)明提出的aca-unet在各個(gè)方面均為最優(yōu),自注意力機(jī)制模塊和特征選擇模塊對(duì)本發(fā)明的效果有實(shí)質(zhì)性的貢獻(xiàn)。

[0091]

(4)損失函數(shù)權(quán)重的消融實(shí)驗(yàn)

[0092]

為了探究損失函數(shù)對(duì)本文模型性能的影響,本文對(duì)損失函數(shù)做了相關(guān)消融實(shí)驗(yàn)。分別設(shè)置背景與前景的比重為1:1,1:2,2:1,用本文提出的模型進(jìn)行數(shù)據(jù)集訓(xùn)練。分別用loss 1,loss 2,loss 3表示訓(xùn)練效果如下表5所示。

[0093]

表5損失函數(shù)消融實(shí)驗(yàn)

[0094][0095]

如表5所示,當(dāng)前景與背景權(quán)重比值為2:1(即w1:w2=2:1)時(shí),訓(xùn)練效果為最好,驗(yàn)證了本文為分割出單個(gè)細(xì)胞而更多關(guān)注背景區(qū)域的合理性。

[0096]

綜上,本文針對(duì)電鏡細(xì)胞自動(dòng)分割計(jì)數(shù)問題提出了自己的解決方案,解決了這一領(lǐng)域的空白。其中對(duì)于密集電鏡細(xì)胞圖像,本文采用特征通道選擇融合及自注意力機(jī)制遠(yuǎn)距離建模的方式提升圖像語義特征提取的有效性。高倍放大圖因?yàn)樽陨碚Z義特征的局限性,即單個(gè)細(xì)胞區(qū)域過大,細(xì)胞間隔小的特征。本文采用通道選擇融合和深度可分離卷積提取語義特征,隨后結(jié)合分水嶺算法進(jìn)行細(xì)胞的分割與計(jì)數(shù)。其中,密集細(xì)胞分割的dice系數(shù)達(dá)到88.94%,高倍放大細(xì)胞的分割dice系數(shù)達(dá)到93.10%,計(jì)數(shù)與分水嶺處理指標(biāo)都符合

預(yù)期。

[0097]

上述實(shí)施例為本發(fā)明較佳的實(shí)施方式,但本發(fā)明的實(shí)施方式并不受上述實(shí)施例的限制,其他的任何未背離本發(fā)明的精神實(shí)質(zhì)與原理下所作的改變、修飾、替代、組合、簡(jiǎn)化,均應(yīng)為等效的置換方式,都包含在本發(fā)明的保護(hù)范圍之內(nèi)。